OpenAI为时12天的冗长的发布会,终于在最后一天因为“o3期货”的发布而迎来了最高潮。因为除了几个刷屏的Benchmark外,额外的信息量其实不多,我也没想清楚应该怎么去评价这个模型,所以选择了没在第一时间去评论。

但在过去的一天时间里,不断有朋友问我“怎么看”。我回答了第二感觉:1、模型的结果看起来很棒;2、但绝对不是AGI;3、受众面很小。

经过一天的梳理和思考,准备写下“第三感觉”,与“第二感觉”其实差别不大,不过区别就是“第二感觉”基本凭借着《思考,快与慢》里定义的系统1(直觉,所谓快思考)完成的,下面的“第三感觉”更多需要借助系统2(逻辑,复杂计算,所谓慢思考)完成。

注:我很buy-in《思考,快与慢》书里的想法,但我内心多少抵触过多的将这套理论与o1模型联系起来,不过既然很多人都习惯于这么讨论,我就沿用这套框架来陈述自己的观点吧。

先将OpenAI对于模型稍显混乱的命名体系来作为开始:为什么叫o3,而不是过去一周言之凿凿的“GPT-4.5”?

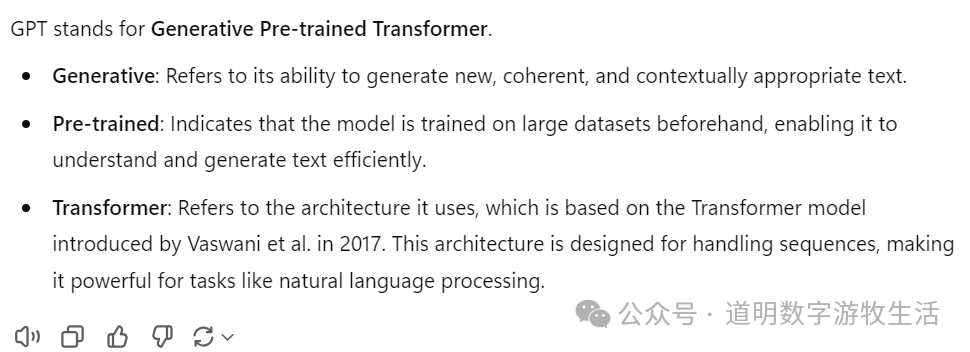

要回答这个问题,首先需要解释GPT:Generative Pre-trained Transformer(ChatGPT的回答)。

所以GPT体系指的是预训练模型。当然这里有个小的疑问:如果以后预训练不用Transformer架构了,是否还叫GPT?按照我的理解,可以,因为我认为的GPT一直是“Generative Pre-Training”,来源于OpenAI的GPT系列的第一篇论文的题目:虽然用了Transformer架构,但是并没有将预训练与Transformer绑定。

在写这一段的初稿时,正好跟女儿讨论到了,我们争论了接近半个小时,因为她理解GPT的“T”就是指Transformer。最后,我们以上面ChatGPT的回答达成了一致:“T”是指Transformer。好吧,看起来她是对的。

当然,“T”到底是指Training还是Transformer在这里不很重要,无论哪种解释,GPT都是指侧重于预训练的模型。

那么,OpenAI在9月份发布的o1又是什么?大家普遍认为“o”指的是“orion”,一个代号。这个实际意义不大。简单而言,“o”系列模型代表的就是基于GPT系列模型之上的“思考”模型,是强化学习模型,是预训练之后用户完成具体任务的模型。

GPT模型就像是一本百科全书,存储压缩过的知识(参照之前的文章:LLM是个压缩器,写在OpenAI直播展示活动之前),“o”系列模型的目标则是如何在有了GPT之后,在“开卷考试”中取得好成绩:因此,我们会看到OpenAI展示o3在AIME2024中取得的“高分”。

至少目前为止,OpenAI关于GPT和“o”系列的命名体系还算清晰:预训练与任务执行。

这里面遗留一个问题:GPT-5在哪里?

其实,在我看来,到了GPT-4o后,作为预训练目标的“知识压缩”已经在文本和一般图像领域完成了“历史使命”。当然会有“GPT-5678”,但是每一代的提升,都需要更多模态和更大数据量(可能每一代都是十倍以上)才有意义。目前,显然还不具备这个条件(参照我上一篇关于2025的前瞻:又到了写2025年AI领域前瞻的时刻了,两个关键词,若干个预测,一个潜在风险)。

所以,其实名字不那么重要了。

但是,区分这两套模型体系还是非常有必要的:

1、大家普遍讨论的“大模型”更多在预训练即GPT层面。市场最关心的Scaling-Law简单的意义就是如果预训练还可以追求更大规模,那么算力投资就可以继续;

2、预训练一直只是通向所谓AGI(通用人工智能)的基础之一,我们现在讨论的模型的功能,比如搜索,比如代码生成,再到“思考模型”,都是如何利用预训练“压缩过的知识”完成具体任务的垂直领域任务模型;

3、以下棋为例,一个就是记忆并归纳总结了海量的棋谱,一个就是侧重于如何“赢得棋局”。当然,DeepMind的Alpha-Go和Alpha-Zero并不完全是这样的关系,后面还要重点讨论;

4、从一个层面讲,无论是GPT系列模型还是“o”系列模型都有“记忆”,毕竟压缩了那么多知识和所谓“思考方法”;但是从我们人类理解的层面讲,这些模型都没有“记忆”:它不会在与我们的交互中更新和改变自己;

关于命名体系的问题基本讨论完毕,以上大概展现了一个“慢思考”的系统2的过程(不一一对应):

1、搜索,无论是自己的“知识库”(或者说记忆),还是外部信息;

2、比对,比如对于“GPT”的含义的查证过程;

3、归纳总结,得出结论:当然我跳了很多步骤;

有意思的是,我并不认为上面的过程体现了所谓的“人类智能”:按照“标准流程”进行的所谓思考估计在多数人眼里也不是“智商”的体现。

这也指向了本篇第二部分的内容,或者说我的核心观点:o3绝对不是AGI,甚至“o”系列模型无法通向我们认为的AGI。

快慢思考的提法出现在本篇开始时提到的丹尼尔·卡尼曼的《思考,快与慢》(系统1和系统2并不是卡尼曼的原创,只是频繁使用)。到了九月份o1模型发布后,各种自媒体就一直在“鼓吹”慢思考。这次o3发布,更是一致惊呼“AGI来了”。

是的,o1模型很强,o3更是在“复杂思考能力”提升了一大截。我也曾点评o1模型的文章里提到下面的这句话:通向AGI的道路越来越清晰了。

是的,那个会思考的O1模型来了:

一句话总结是,我们第一次有了大模型的“指挥官”,“规划者”,“思考者”;再加一句是,通向AGI的道路已经越来越清晰。

道明,公众号:道明AI实验室

“草莓”来了,那个期盼已久的“指挥官”

如今,到了o3后,通向AGI的道路当然更清晰了,不过在我看来,这是因为o3很可能指出了一条不会到达AGI的错误道路:慢思考不能“通向人类智能”。

卡尼曼在自己的书里不止一次强调,他的理论不是要强调“慢思考”的系统2,而是如何借助系统2客服“快思考”系统1的不足,增强系统决策能力。背后根本原因是,人类的系统1无法被关闭,随时随地地影响着我们的决策。

我的理解是:人类的智力或者说智能水平可能更多地体现在“系统1”上。

展开来说,“系统2”的所谓逻辑或者“思考”能力绝大多数可以靠后天学习和训练习得。是的,o3的工作模式确实跟“系统2”很像,结果也很“炸裂”。

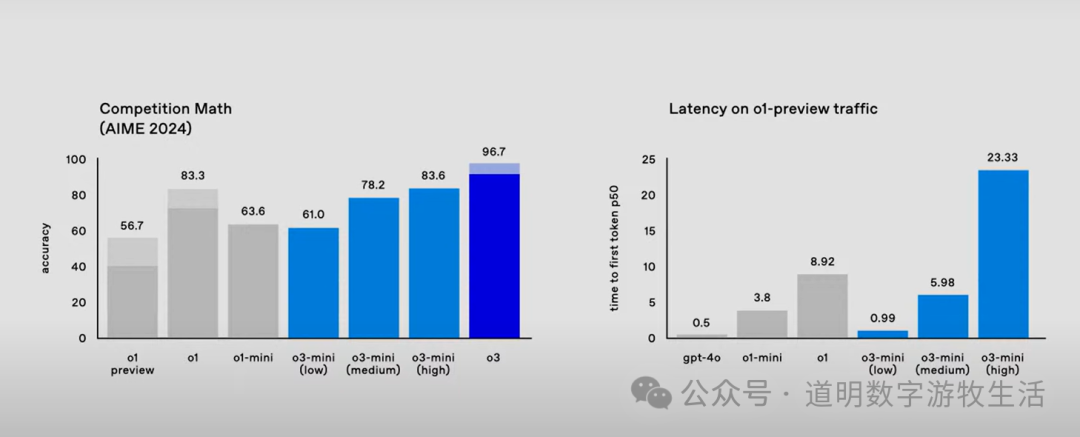

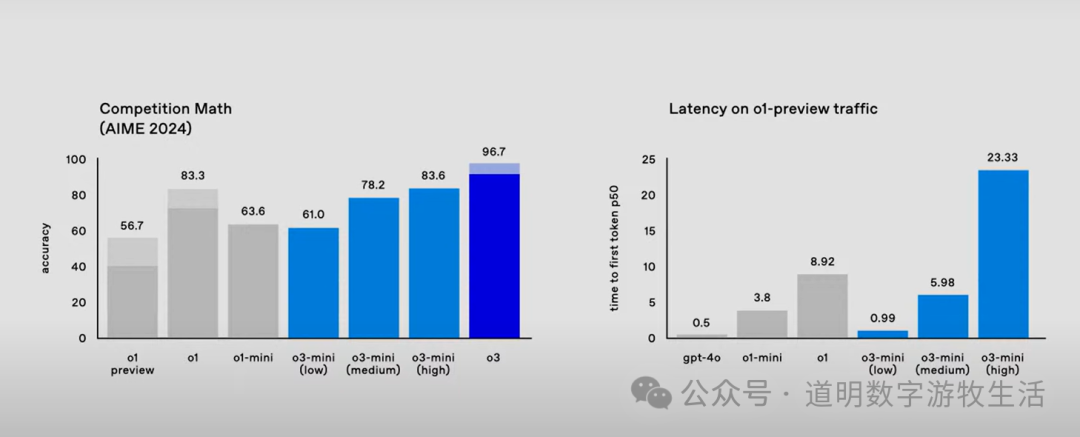

可是如果我们再细看一次上面的AIME竞赛的表现,问题就来了:o3比o1-mini提升了约13分(96.7比83.3),但是,延迟增加了接近两倍(23.33秒比8.92秒)。假设o3模型规模跟o1一样(实际上肯定远远高于,因为OpenAI声称测试时训练的sacling-law依然有效),就等于o3以接近三倍的成本将分数从“A”提升到了“A++”。

也许,在包括我在内的许多人看来,这种成本是值得付出的,毕竟我们获得了一个在数学竞赛里表现顶尖的“人工智能模型”。

但是,如果我们用人的视角来讨论这个问题:就类似于,同样的数学竞赛,如果一个十岁的孩子得了83.6分,而一个十八岁的高中毕业生得了96.7分,你会觉得哪个人更聪明?哪个人“智商”更高?

这当然是一个见仁见智的问题,但是,我相信,至少有包括我在内的不小的一部分人,会认为十岁的孩子“智商”更高。

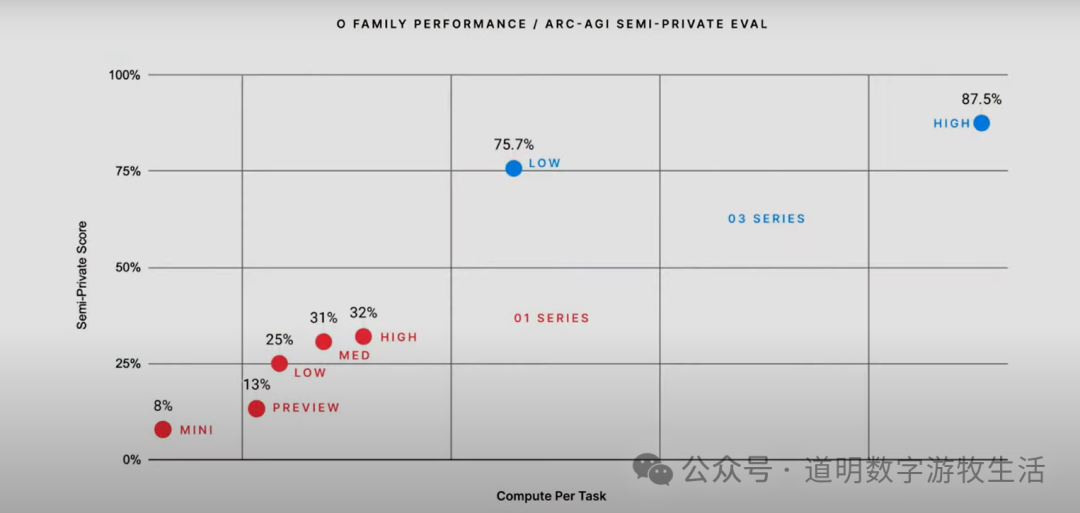

回到模型的表现上来,或许更公允的说法是:如果不考虑成本(OpenAI自己宣称以75.7%的准确率解决一个低计算强度任务的成本是20美金,高计算强度任务则需要1000-6000美金,当然准确率也相应提升到87.5%),o3可能在具体任务上超过了绝大多数人类的表现;但是,这种具体任务上的良好表现,跟人类理解的“智能”并不在一个维度上。

简而言之:o3模型可以成为一个很好的“解决问题”的Agent,却不是我们想要的AGI。

那么,问题在哪里?

首先是定义的问题,其实关于“人类智能”,我们似乎也没特别统一的标准。就最通用的所谓智商测试而言,普遍认为是年龄越小测试结果越有代表性,似乎,我们承认,“学习和训练”影响了“智商测试”的客观性,是不是我们更多人愿意承认“后天习得”的“解题能力”并非“高智商”的表现?

当然,一般意义上,我们大概也有一些对于“智商高”的评判标准:反应快,记忆能力强,对于从没遇到过的问题,可以更快的找到解决方法,等等。

这可以引申到问题的第二个方面,关于模型能力的评测标准问题。我们看到的ARC-AGI评估体系,只是反映了单一维度:解题能力。这当然能一定程度上体现出“智能”水平,但是与我们理解的“智商”的相关性很可能就是偏低的。

其实,这没有任何问题,只要成本合适(而且未来随着硬件升级会不断降低),模型能比绝大多数人拥有更强的解决问题的能力,却不表现出与人一样的“智商”,不就是很多人期望的吗?

第三,技术层面的问题,值得更深入探讨。

继续回到系统1和系统2的框架下。

一方面,我们上面提到的一些人类普遍关于“智商高”的评判标准,似乎更适用于系统1的定义范围:凭借直觉、经验,快速做出反应和决策。我们可能不会发自内的夸赞一个花了超过三分钟得出“17X48=816”的正常人“聪明”,但是我们大概率会赞叹十秒甚至五秒内报出答案的人。

某种程度上讲,系统1的能力与“智商”的相关性会更高。

其次,人类的“联想”能力可能就是很多创造力的来源。我们应该有这样的经验,很多时候,从几个词想到另一些词,从一个概念想到另一些概念,几乎是下意识的,瞬间的。在“快慢思考”的书中,也不乏这样的例子描述。在这个过程中,可能系统2也会参与工作,但是,显然,系统1在这种决策中的重要性更高;

再次,即使同样是系统1和系统2,不同人的系统的能力或者边界也是不同的。举个书中的例子,回答“2+2=4”这样的问题,被卡尼曼列入了系统1的依靠直觉做决策的范围。然而,这种边界是因人而异的,有些人可能对于两位数甚至三位数四位数内的加减法都是可以凭“直觉”瞬间反应的,而有些人则可能需要专注下来,调用系统2“慢思考”一下才能回答。

这种差异,固然有“天赋”因素存在,更多的,可能恰恰是靠大量的“训练”获得的,如钢琴家的肌肉记忆,如足球守门员出色的反应速度,等等。

也许,大量的系统2范畴内的训练至少可以提升系统1的能力。

以上,如果回到模型,大概可以这么总结:如果真的存在AGI,那么更可能是系统1主导,系统2辅助,系统2范围内的训练更多是为了提升系统1的能力。

这些,也导向了我的结论,我既不认为强调“慢思考”的o3是AGI,更不认同沿着“慢思考”这条路的“o”系列模型可以通向AGI,因为现在的模型体系下,找不到任何“慢思考”的“o”系列模型可以提升OpenAI公布的任何模型中的系统1的能力。也许,以后会有,但是现在并没有。

那么,为什么沿着“慢思考”路的“o”系列模型不能提升系统1的能力呢?

以前文留下的关于DeepMind的Alpha-Go和Alpha-Zero模型作为例子,进一步讨论。

诚然,围棋是一个相对封闭的任务领域,Alpha-Go和Alpha-Zero两代模型却大概可以呈现超级AI的一种研发的路径和方法。虽然并不完全贴切,但基本可以将Alpha-Go理解成一个基于预训练的模型:“学习”极海量的棋谱,而Alpha-Zero则是一个深度强化学习模型:在不断地对弈中学习对弈。

在实际对弈过程中,Alpha-Go每一步都是在搜索可能的选项,计算潜在胜率,然后做出胜率最高的选择。模型能够“看到”的未来的步数,基本上代表着模型的能力,但能够“看到”的步数越多,思考的也越“慢”。自然,这个过程几乎都是系统2的,自然,也有很多人会质疑,胜过人类最顶尖棋手的概率计算能力并不能代表模型比人聪明;

而到了Alpha-Zero时代,已经很少听到上面的质疑了。尽管系统2一定仍在模型的运作过程中发挥着巨大的作用,但是通过不断地在“对弈中学习对弈”的强化学习的过程,Alpha-Zero已经慢慢的将“围棋能力”变成一种直觉或者本能。如今的Alpha-Zero早已成为了棋手的朋友和陪练,再顶尖的棋手也都能从与Alpha-Zero的对弈中提升自己的能力。这自然也要归功于系统1的引入(这个表述不完全准确,但大体是这个意思)。

Alpha-Zero的这种模式,给出了通向AGI的一条非常理想的道路。其实,主流的前沿模型开发者,无论OpenAI,还是Google或者Anthropic,甚至其他公司,首选的路线图大体上应该也是如此的。只是,这里面有两个非常重要的点:1、我们是否有足够的有标签(labeled)数据来进入强化学习(监督学习)阶段;2、AGI首先面对的问题要足够开放,但是在开放领域里,很多问题都是没有标准答案的,而且是极度个性化的,一个不能根据与用户或者世界的交互产生“记忆”并自适应调整自己的模型,不能在交互中不断提升系统1能力的模型,自然很难符合“AGI”的定义。

足够多的数据,“记忆能力”,不断训练产生系统1的“类直觉”能力。

是的,这其实大概就是为什么我一直以来更看好Google DeepMind的原因:1、Google有足够多的用户数据,这是带标签的,虽然这些数据并不能够直接拿来训练,但是基于这些数据生成高质量的带标签数据,是Google比较独特的优势;2、DeepMind一直都是强化学习领域的先行者,有足够的储备,同时DeepMind也一直都在尝试通过有记忆的强化学习通向AGI(参照:世界模型:科学家打游戏,工程师搞艺术);3、Google的生态能力可以给予模型更多的与用户和具体任务交互的机会,甚至有机会实现用户“个性化”的模型,并通向AGI;

以上并非要推荐Google,只是如果把Google DeepMind的这些优势列出来,并与OpenAI进行apple to apple的比较,或许,我们可以得出更公允的结论:某种程度上,“o”系列的慢思考模型是必要的,但是押注在“慢思考”上可能也是OpenAI无奈的被动选择。

毕竟,OpenAI在这之前是一家没有独家数据,没有场景的纯模型公司,即使ChatGPT已经是日活前八的APP。但是有多少用户会给模型反馈,提供“价值连城”的带标签数据?又有多少强场景提供模型跟用户交互并可以提供“个性化模型”的机会?

OpenAI也不是没有意识到这个问题,所以不断有功能被加入到ChatGPT中,但是这种特别细分领域的两年的数据积累,又如何与Google、Meta、Apple等公司比较呢?

写到这里,我基本完成了关于“o3”模型评价的系统2慢思考过程。论据不一定正确,逻辑不一定完整,结论也自然不一定正确。但是,关于AI或者AGI的问题,不就是给我们人类一个不断研究自己,反思自己,发现自己的机会吗?

最后,可能还会有朋友关心,“o3”会不会拉动算力需求:

1、“o3”最高精确度模式下巨大的推理成本(几千美金一个任务),并不意味着训练“o3”需要更高昂的算力开销;

2、如今的格局下,未来三五年内,对于模型训练投入的算力开销已经基本上是个相对确定的值(集群算力的进步速度,芯片厂产能,数据中心能源供应,数据量,等等因素共同决定)。至于推理,需求当然非常大,但是对不同算力类型的兼容性也更强;

3、“o3”最适合的应用领域是科学研究、生物医药等非常前沿,受众面又非常小的领域,单一项目都可能是一个“天价”成本支出,但是总和相对于目前各科技厂商的资本开支而言,依然是个很小的数字。

结语:不考虑使用成本,“o3”毫无疑问是一个非常重大的进步,在科研、生物医药等领域,主打系统2“慢思考”的“o3”有很好的应用场景。可是,“慢思考”大概率不能导向“AGI”。模型发展到现在,缺乏场景和数据的OpenAI正在进入一个很难突破的“瓶颈期”。