当发现Kimi OK Computer能够处理的输入量大概就是一篇几十页的文档后,就开启了一个“小挑战”:每次给OK Computer一篇文档,然后去生成一个互动站点:

每次都能仅消耗“一条命”完成一个网站;

外观审美很好,有符合主题的配色,背景图,交互动画效果;

但是内容上,往往“自由发挥”的有点多,会加入不少虽然相关但并不在文档里的内容;

小错误还是很多的,大概可以形容为:理想远大于能力;

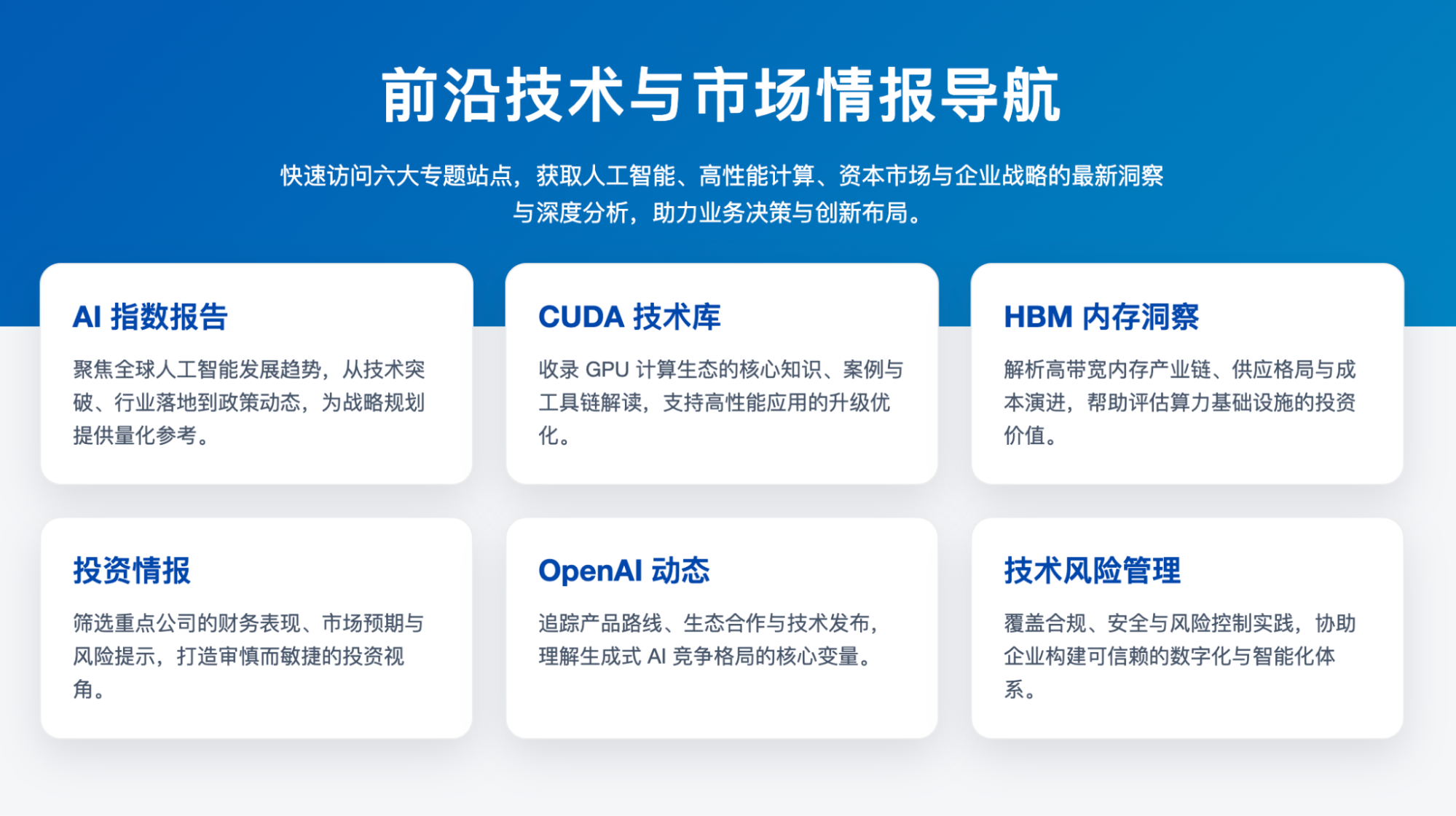

消耗掉了这个月剩下的次数,做了六个内容,用codex简单生成了个目录首页,放到了vercel上:

并且简单录了个视频:

当然,OK Computer生成的网站最大问题就是很难改,既很难让它改,更很难让人改,所以,就看个热闹吧,做做简单的有声读物,帮孩子学学历史学学英语,应该是有不小帮助的。

OK Computer背后的K2模型,跟OK Computer自然是一样的特点:一次生成还行,但是改动就很难了,所以,显然还不能成为可靠的vibe coding模型。

最近一段时间因为用量巨大,而Claude Code的用量限制过于难受了,所以只能更多使用Codex。

Codex的GPT-5-codex-high能力很不错,而且在GPT的Pro订阅下,至今没碰到过用量超限问题;

Codex“自由发挥”程度相比Claude Code(Claude-4.5)小很多,意味着相对更频繁的人工输入(模型会相对更频繁的停下来询问),以及不断要给Codex补充细节;

所以,绝大多数场景下,还是Claude Code的效率更高,完成度更高,细节丰满度更好;

当然,Codex在执行过程中使用的折叠很多,所以看起来屏幕更静止,相对而言Claude Code看起来更忙碌,更“Vibe Coding”;

PS:这篇文章本来在三天前开始写,但是因为忙其它事情就断了。现状是,Anthropic在这两天又更新了Claude Code的rate limit政策,总体上又下降了不少,而且质量明显变差了。

这基本上是倒逼我弃用了,相反,codex还在勤勤恳恳的干活,从晚上八点到现在已经快两小时了。

所以,但凡差距不是非常大,换个模型也总是有办法解决的。

我知道我的行为有“提前性”,只要最好的模型有超过一个,卖token就不太会有“暴利”。

当然,今天闲暇时间在听一个艺术家的访谈时,得到了新的启示:我觉得我想错了OpenAI,想错了这个节奏,总不自觉地存在长期看好,短期波动的“金融思维”。但其实,对于当下撬动超万亿美金s的OpenAI而言,要么成功,要么就抱着大家一起“毁灭”,似乎已经没了中间路线可言。