这会是我近期最后一篇关于国产模型+Agent的评论,原因如下:

我基本试到了各家的能力边界,其实都差不多;

虽然产出结果从外观看普遍效果很好,但是如果要考虑Scaling和常规化,成本其实极高;

相比之下,GPT+Gemini+Claude始终可以给到我稳定、可控、可持续的结果,这方面国产模型+Agent依然有很长的路要走;

是的,如果完全客观的评价,特别是在国内的网络环境里:

国产模型+Agent是很不错的平替,我相信百分之八九十的场景下,都是可用的;

然而,其背后耗费的人力、时间、token成本远比想象的要高,这回答了我前几天提出的一个问题,勤固然能够补“拙”,多,有时候却是少;看起来的“少”,最后却成了多。

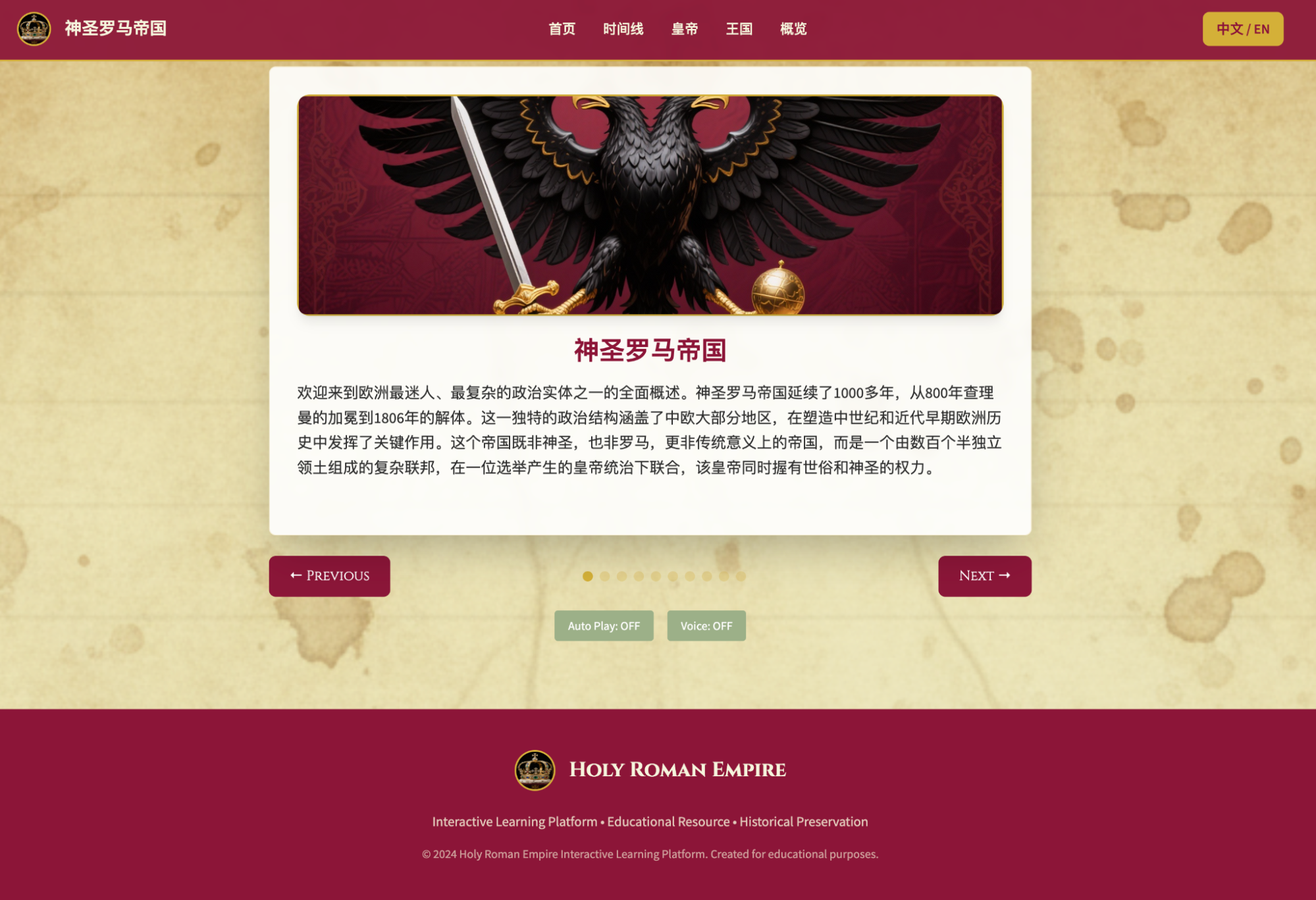

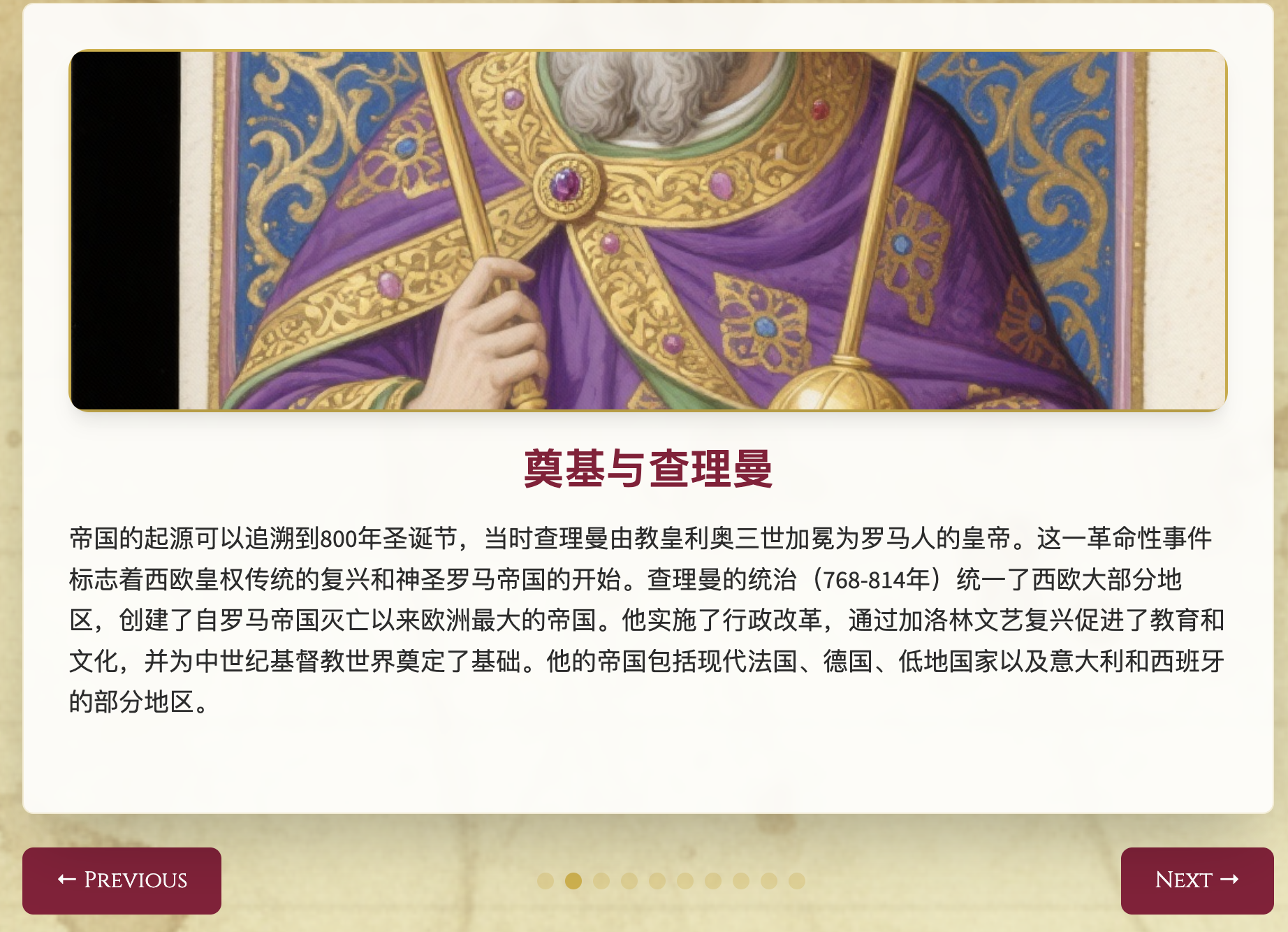

回到之前的一篇:为神圣罗马帝国跨越千年的历史生成一个网站的“野望”。

是的,上次文章里呈现的结果几乎就是Kimi OK Computer可以达到的极限了。于是,我使用Claude Code连接了Kimi的API,希望从Agent环境跑到更大的开发环境,依靠K2模型能够让项目走的更远一点。

K2的定价其实并不便宜,甚至可以说很贵,尤其是turbo模型只是将推理性能提升到了最高100tokens/s。相比之下,Gemini-2.5-Flash能力强很多,生成速度快很多,价格,算下来还是更便宜的。

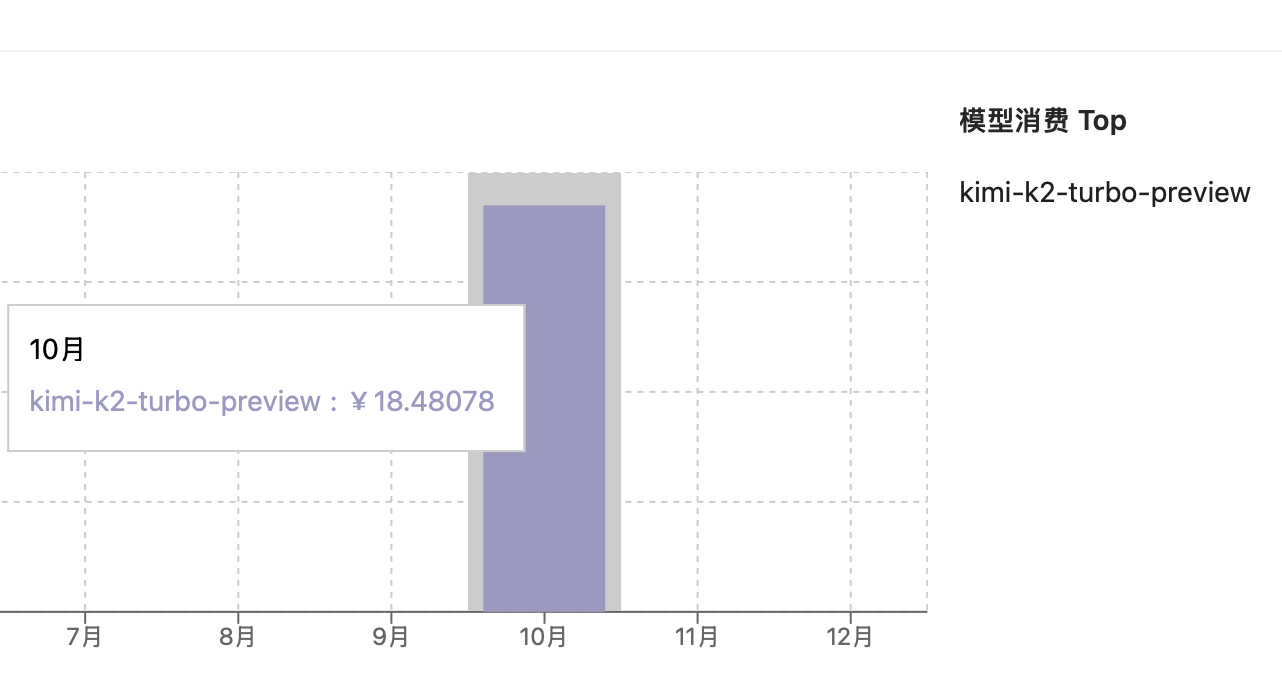

在三个小时的不断尝试中,消耗了18.5人民币后,我实现了对前一个结果的改进。

改进的部分也很聚焦:Overview,当然音频问题就无法解决了,Claude Code不支持。

到这里,我果断放弃继续利用Kimi优化的想法了。我做这些事情从来不是为了得到一个所谓“好的结果”,而是看重依靠模型本身,适度的人工参与下,可以到什么程度。

我有了两个答案:

这一代模型的能力就到这里了,Agent部分的优化可能可以让产出变得更多,如同一会儿介绍的MiniMax那样,但是没有本质区别了;

综合下来,模型的使用成本还高于Claude,当然也远远高于GPT和Gemini;20美金/月的Claude订阅,每五个小时的计费时间窗口里,即使我负载加满,也可以工作一小时,足够把上面网站内容部分的bug全部优化好,同时别忘了,使用额度每五个小时都会重置的;当然,更别说Gemini每天还有大量的免费额度,GPT也给了订阅用户非常慷慨的codex里的使用量;

很多时候,多就是少。

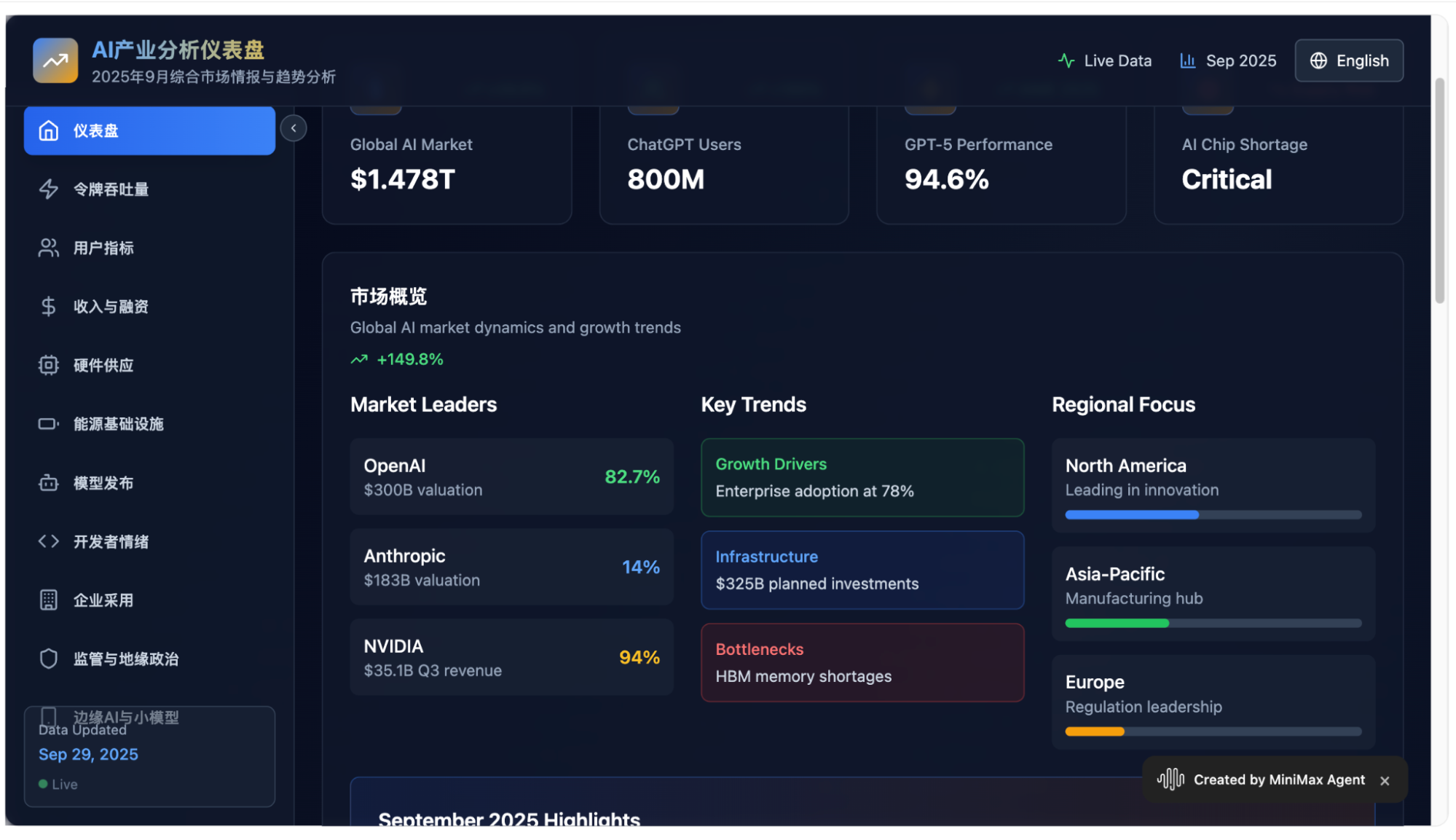

当然,上面的例子显然是因为我对Kimi的要求太高了,那么降低负荷,同样针对一份Gemini中产出的AI日报进行多模态的播报,耗费了两次OK Computer的请求后,得到了一个完整的“一键到底”,视频如下:

在这样的量级下,我又成功的完成了几个小的音画兼备的多模态slideshow。

当然,这种由Manus开启的Agent应用(Manus并没有自己的模型,也不不具备声音的模态,我坚定认为没有自己模型的Agent通用应用路基本是越走越窄的),看起来已经成为国产模型的标配了。比如,同时一直在试的MiniMax,GLM……

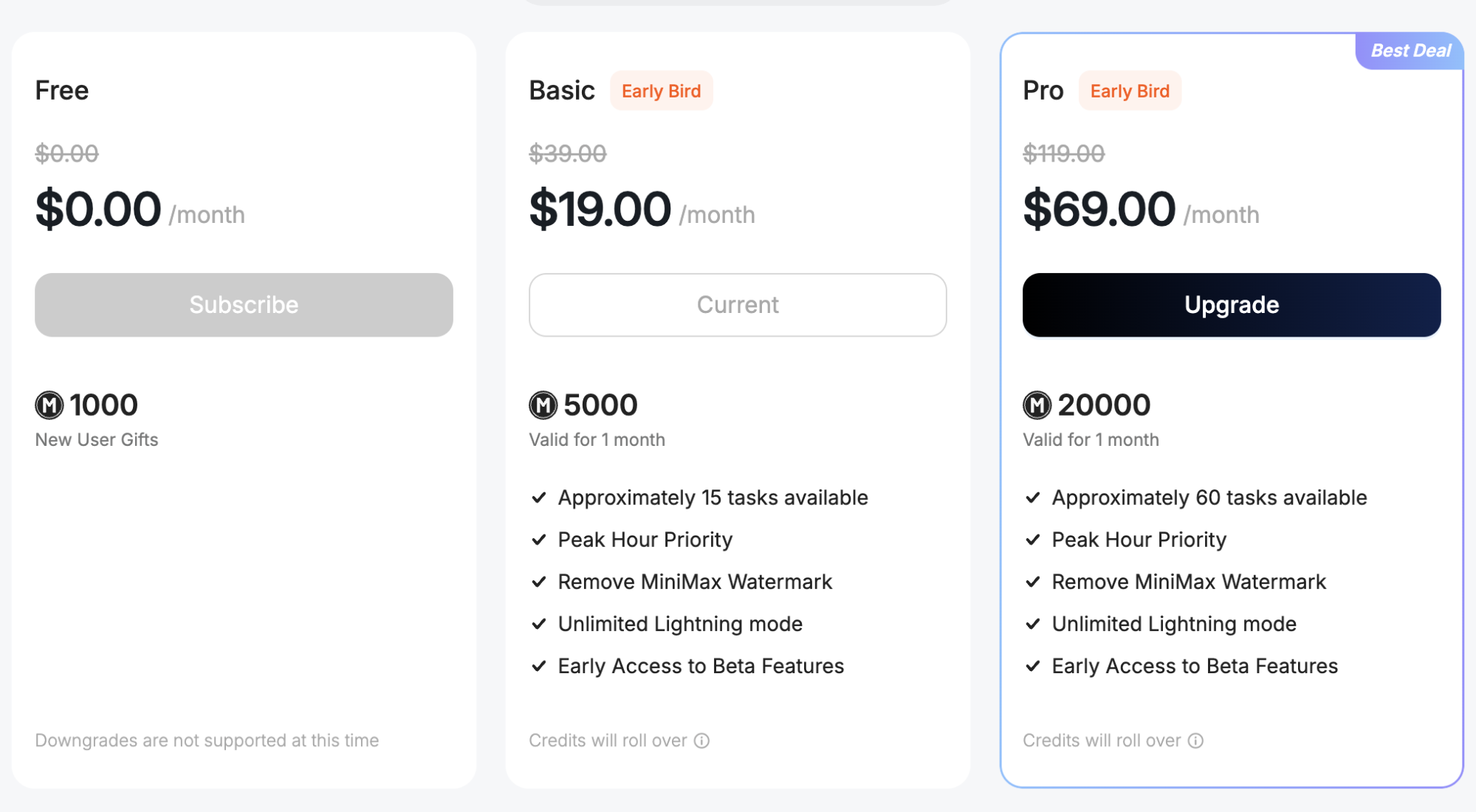

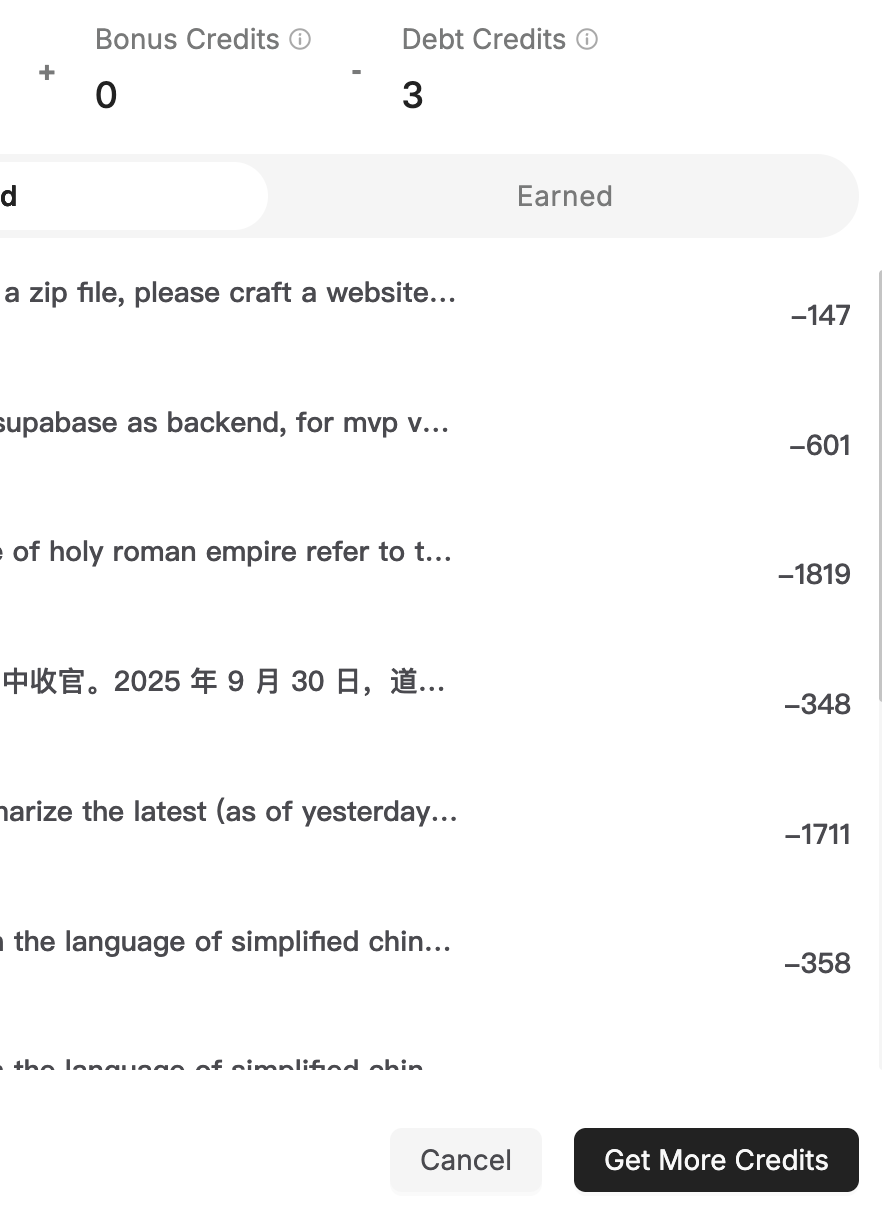

然后,几个轮次,就消耗光了月度订阅的5000积分。

扣掉1819积分的是希望复制Kimi OK Computer里的神圣罗马帝国的有声交互网站,因为有过OK Computer里踩坑的教训,到了MiniMax中,提示词会多写很多,当然MiniMax默认会有vite框架,信息承载量也更大,所以结果的完整度会更好一点。

当然,虽然音频部分完成的更好,也有更多的历史地图。但其实总体信息量跟Kimi的版本只能说基本差不多,然而审美上,显然Kimi会统一的多。当然MiniMax的这个版本,其实是我已经把一些Kimi生成结果的截图给到以后的结果了。这个结果的链接是:https://g1h6svu4arx7.space.minimax.io/

可是这样的结果耗费了超过1800个积分,意味着19美金/月的订阅包,一个月只能做三次这样的。

可是,如果使用Claude Code,在20美金/月的订阅下,每天至少可以完成一次,音频部分虽然Claude自己没有,但是可以给到Gemini的样例代码,直接写出来,这个对于我而言已经是常规操作了,关键是,每天至少有几十次Gemini-TTS的免费调用额度。

从这个角度讲,MiniMax实在太贵了。

当然,有兴趣的朋友还可以看我耗费1700个积分生成的网站:https://4m2xwqqvu8zl.space.minimax.io ,当然,又是一个“半拉子工程”。

其实,如果再去看Minimax给出的很多用户生成的案例的话,几乎全是这类网站。

看起来很漂亮,可是,它只是适合静态内容,比如上面的站点如果每周要更新一次数据,那都得重新来一遍,且不说1700积分的消耗,结果还都会很不稳定。一句话,无法产品化。

也许,无论是Google AI Studio里的build,还是Claude Code,甚至GPT-5的codex,虽然结果看起来没这么漂亮与花哨,但是在更低的成本消耗下,都可以实现可服用的产品化,如今每天支持我产出各类结果的工具,都是这样实现的。我清楚知道成本有多么可控,和,低。

又是一个“多就是少”。

还有很多可以说的,但还是到这里收尾吧,再补充几点更多的结论:

其实,早在去年底Google发布Gemini-2.0时,今天各种例子,理论上就都可以实现了,当然有了Agent的帮助,可以大幅提升效率,然而,Agent再好,也需要底层模型能力来配合;

在又一年进入尾声,Gemini即将迈入3.0的时代,比拼的已经再也不是单一的大语言模型了,是文生图,文生视频,语音模型,音乐模型,更是比拼生态;

也许,单一模型奋力追一下,能保持甚至不断缩小差距,但是如果在模型库里就是缺了东西,或者就是每一项看起来都有,但都是差那么点,合起来可能就差很多;

这还没考虑生态,推理成本,用户质量(付费意愿与付费能力)等等一系列问题;

我反复计算过一个数字,在设想的AGI或者ASI(真正超越人的智能)到来之前,模型的深度用户就是那小几千万的“程序员”和专业人士(和所在的企业,或者企业的深度用户);

在高度竞争,快速迭代的巨额投资推动的当下,不能占领这几千万用户的心智,不能从他们身上创造不断倍增的收入,就容易陷入投入越多回报却越低的“恶性循环”,甚至,一旦停止投入就立马出局的“困境”;

不能再展开下去了,我希望自己这些判断是错的。当然,不管如何,如题目所述,这就是近期最后一篇国产模型+Agent的评论文章了。