注:以上的截图可能清晰的展现了本文超过50%的意思,即,模型的进步正在遭遇挑战,甚至,一些不当的训练方法正在让它变差。

一段时间没写AI方面的点评了,过去一段时间,点虽然很多,但都是需要“让子弹飞一会儿”的;受各种干扰带来的争议也很大。索性做一段时间案头工作,改变一下原先的节奏,再来看,不知道是不是会清醒一点。

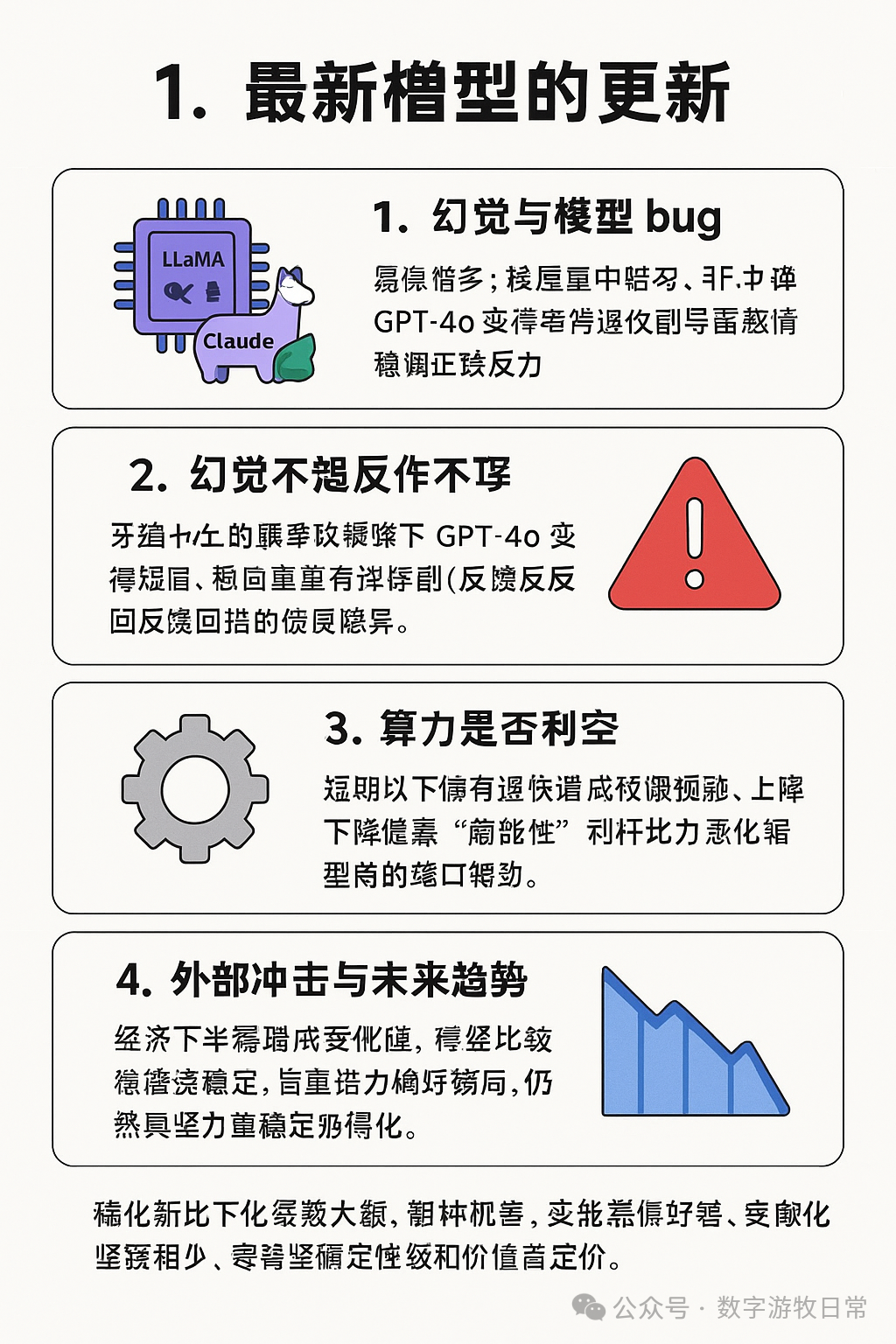

最新模型的更新

从LlaMA-4开始,到o3正式版和o4-mini,包括最近的QWen-3……

每一次发布打出来的评分表都激动人心,但是实际使用下来的结果却似乎总是差强人意,甚至是令人失望。

从好的一方面来看,自ChatGPT问世的两年多来,AI的实际应用场景已经拓展了许多,用户很快就能从实用场景发现模型的不足。

但是更客观的评价就是:评分体系已经落后了,模型很容易通过“刷题式训练”的方式创造出好成绩。

LlaMA-4和QWen-3都使用了更多的预训练数据,特别是llama-4的实际表现与Meta团队宣称的差距甚大。

这差不多可以表明,单纯堆数据量已经开始对模型产生了“反噬”,数据,重“质”而不能重“量”,也或许表明,有效的互联网数据可能已经“耗尽”了。

当然,也有正面的例子,更早之前Claude-3.5到Claude-3.7就是一次非常显著的飞跃,尤其是程序能力方面,我们都知道这主要归功于Claude团队在程序方面的高质量生成数据。

更大的进步来自于Gemini-2.0到Gemini-2.5。早在Gemini-2.0 Pro发布时,我就说过这是最好的模型,如今Gemini-2.5给了更多人这样的感受。

当然,OpenAI更早时间推出的Deep Research,GPT-4o模型的生图能力……

是的,最好的模型还是Gemini,GPT和Claude这三个,甚至我越来越确定他们形成了较好的正反馈:利用自身模型生成的高质量数据,可以提高自身模型的能力。

其他家,或许还被拦在“正反馈”的大门之外。

我相信,这种“正反馈”效应还会持续一段时间,但我更倾向于认为,它的进步速度是低于市场预期的,甚至差距正在不断扩大。

同时,这样的“正反馈”也无法让我们进入模型的下一个阶段。

幻觉与模型的bug

OpenAI发布的o3正式版和o4-mini版明确的提到了“幻觉率上升”的问题。实际应用过程中,我也发现了更多奇怪的“幻觉”,很多时候,模型的思考过程显示出它“明知道”正确答案,但就是会在最后给出一个错误的答案,而且无法通过对话被纠正回来。

同样的,GPT-4o的最近一次更新被发现模型的回答变得“很谄媚”,OpenAI官方回应大概的意思是:当他们把用户反馈(👍和👎)加入到后训练环节时,这样的“谄媚”发生了,模型不再坚持先前训练到的“知识”。

模型的不稳定,无论是模型更新还是本身的随机性,正在成为模型大规模进入实际应用的最大阻碍。

如果我们扩大内涵,把这些错误都笼统的叫做“幻觉”的话,那么,其实重要的根本不是“幻觉率”,而是“幻觉量”。

先前很多关于模型差错率和人类差错率的比较根本站不住脚:一个99%准确率但是百倍于人类效率的AI发生错误的次数是90%准确率的人的十倍。

这个问题在我几乎全天侯沉浸于vibe coding后变得越来越突出:我不得不不断修正方法,放慢节奏,让自己有时间修正它的错误。

同样,它也适用于无人驾驶、AI问诊等等等等一系列严肃的场景之下。因为AI的引入,标准应该也变化,我们需要的安全性不是一个标准差,而可能是三到五个甚至更多。

我相信这个标准迟早可以达到,但它不会在明天,不会在三到六个月内,甚至不会在一两年内,而在达到这个更高标准前,我们是痛苦的。

这是否对算力是利空?

某种程度上是的,但是在市场预期已经下调了很多的环境下,有些情绪已经过度悲观了。

信息技术领域的每一次重大突破,都是新算法叠加规模效应而产生的。算法是可遇不可求的,但是规模总是阶梯式上升的。在这个过程中,最好的硬件面临的总是供给不足而非需求不足问题:从去年下半年对NV谨慎时就说过它面临的是技术攻坚问题,因不断延期导致产品更新节奏变化带来的下游开支计划调整,看起来是需求,实质还是供给。

然而在突破下一阶段的积累时期,最好的算力依然还是稀缺品,因为它意味着更大的确定性和更低的拥有成本和时间成本。

是算“能力”,而非简单“算力”。

短期外部冲击的大波动逐渐平稳后,实体与虚拟的分化趋势也许会逐渐清晰。在可预期的全球实体经济下行和生活成本上升,以及模型瓶颈双重作用下,也许一段时间里都不再有趋势性的机会,更多的价格波动带来的机会,但是来自于为下一阶段突破积蓄的“基础设施投入”大概依然可以提供更高的确定性。

来自于提高“质”而非“量”的努力,依然具备更高的门槛。