调整了一两天,重回案头工作的节奏。

实话说,Gemini 2.5-Pro 发布有一段时间了,但是一直没有认真的在“生产环境”里测试过,反而是用新版 GPT-4o 干了很多“生图”的活。

在移动的手机环境下,确实 ChatGPT 和 Claude 更有用,一个做 Deep Research + “娱乐”,一个做“可视化”。

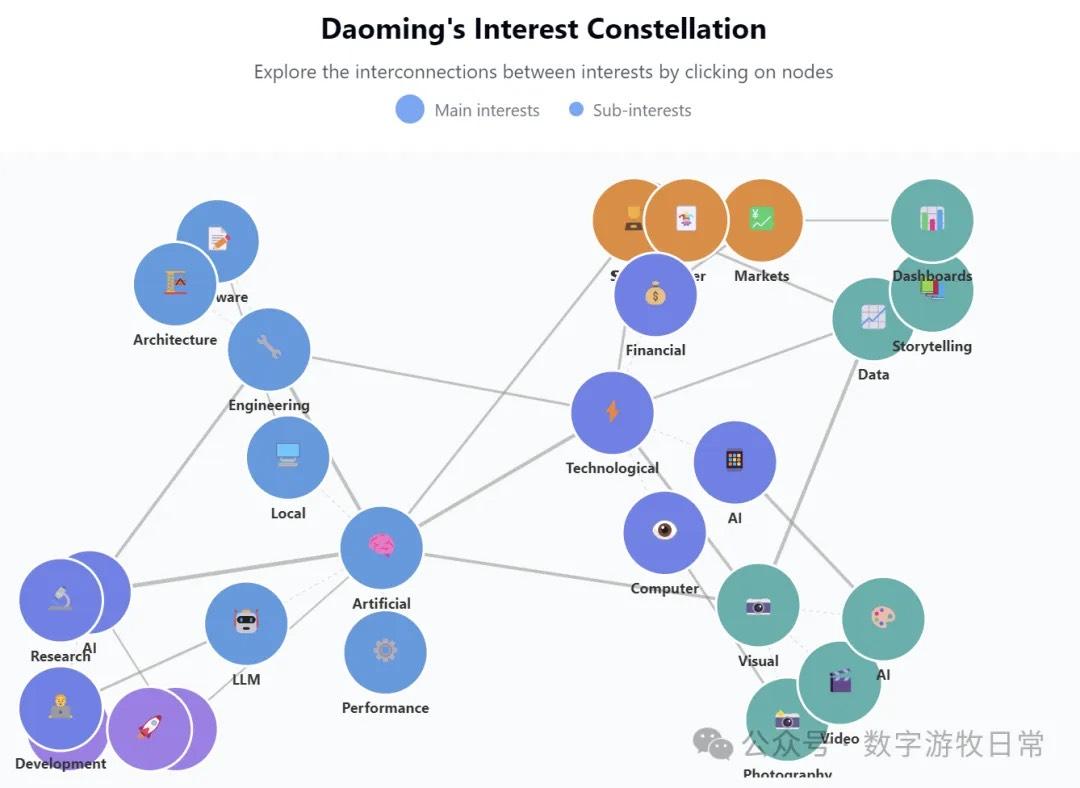

当然,如果把这些模型串起来也会很有意思,比如,用 Gemini 分析自己的搜索记录,然后用 Claude 做可视化,或者直接用新版 GPT-4o “生图”,就会出现不同的效果。

比如,Claude 3.7 的可视化效果,妥妥生产力工具。

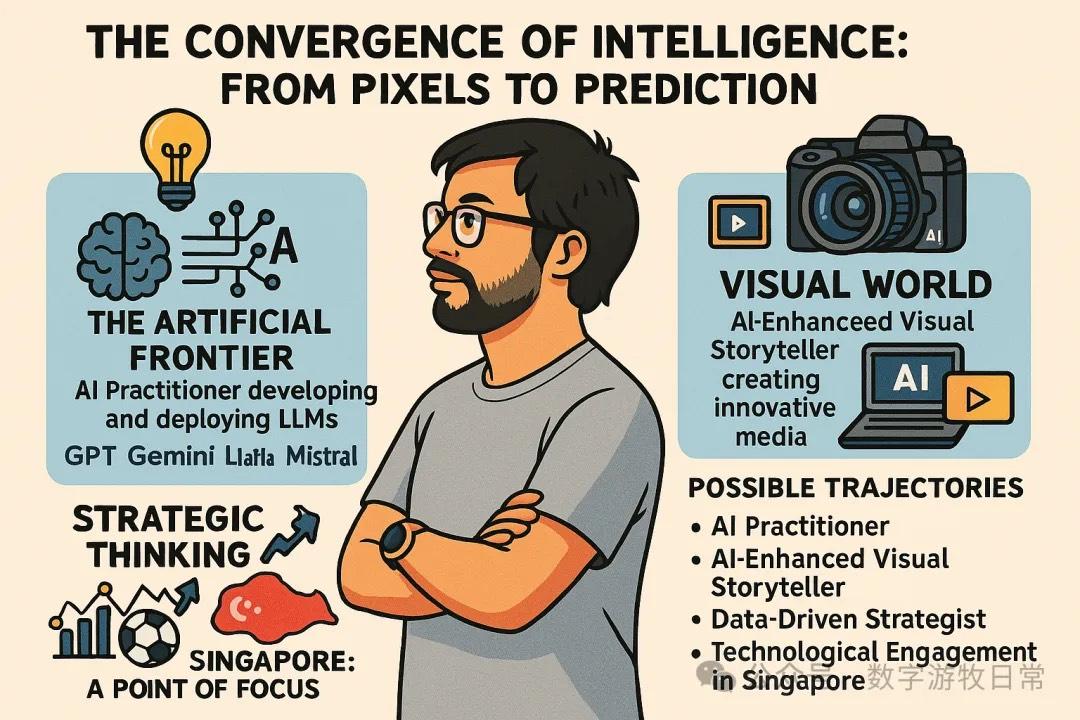

当然,如果用新版 GPT-4o,就完全是不同的画风了。

显然,从风格上来讲,自然偏好新版 GPT-4o 的结果,哪怕在细节上因为 token 量的限制存在瑕疵,但依然必须承认,这个效果已经无限接近“专业级”的娱乐需求了。

是的,ChatGPT 依然是日活最大能力最全面的模型:

- 几乎所有场景,ChatGPT 都能给出还可以的结果,一个很奇特的现象是,每次无论是 OpenAI 发布新模型还是竞争对手“脚踩 OpenAI”,ChatGPT 都能有更快的日活提升;

- 无论 OpenAI 的 Deep Research 是不是一个相对独立的模型,它依然能对每个问题都能给出最全面最完整的回答,当然,相对而言,因为搜索方面的“短板”,它的来源引用量和“新鲜”程度确实都不如 Gemini 2.0 加持的 Deep Research(但是 Gemini 的 Deep Research 输出篇幅有点短,同时对于长提示词会造成注意力偏移);

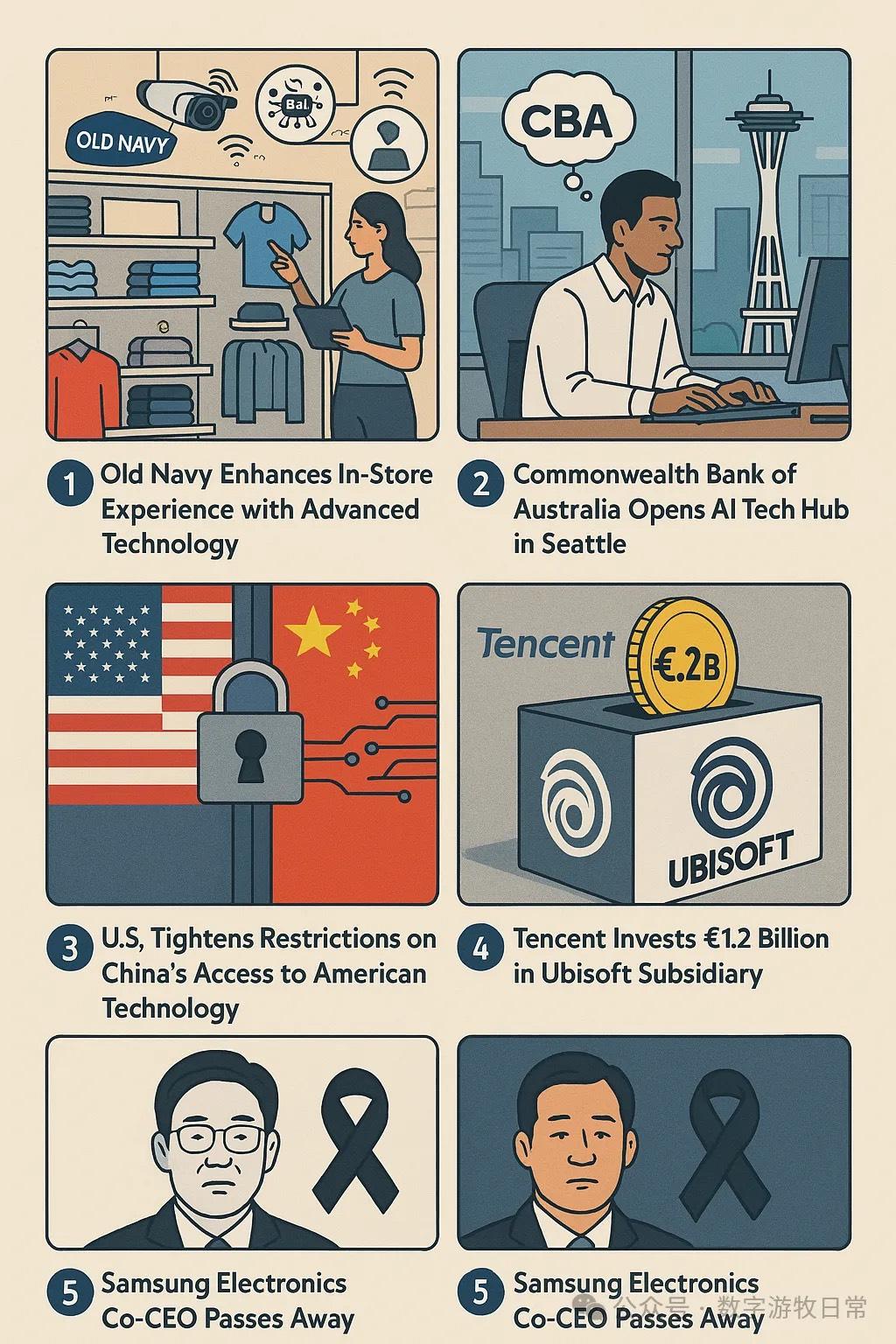

- 新版 GPT-4o 恐怖的生图能力,不仅仅是来个 Ghibli 风格,而是可以成为海报利器,是的,我相信 99% 的人不如它;

- OpenAI 接下来的秘密武器可能就是藏在背后的“世界模型”,虽然从上到下一点点生成的过程免不了“刻意为之”的嫌疑,但是对算力的更大需求应该也是事实,我只是好奇,到底是以图像表达的文字需要的 token 数量大,还是以文字表达的文字需要的 token 数量大?

- 大力“玩梗”当然不仅仅是为了娱乐,“模型即应用”才是那个已经开始毫不掩饰的“野心”;

生产力中,生图当然只是很小的一部分,处理文档才是一个非常重要的高频场景。自从 Gemini-1.5 提供了百万 Token 的上下文支持后,Gemini 系列模型就一直是我最重要的文档处理工具,勤勤恳恳的劳模。

不过,百万 token 是输入的上下文,输出上下文还是会限制在 8K,所以如果要对一本几百页的书做完整总结的话,最好的方式是一章一章来,当然,Gemini 模型“劳模”的具体表现还在:真的可以勤勤恳恳的一章章来。

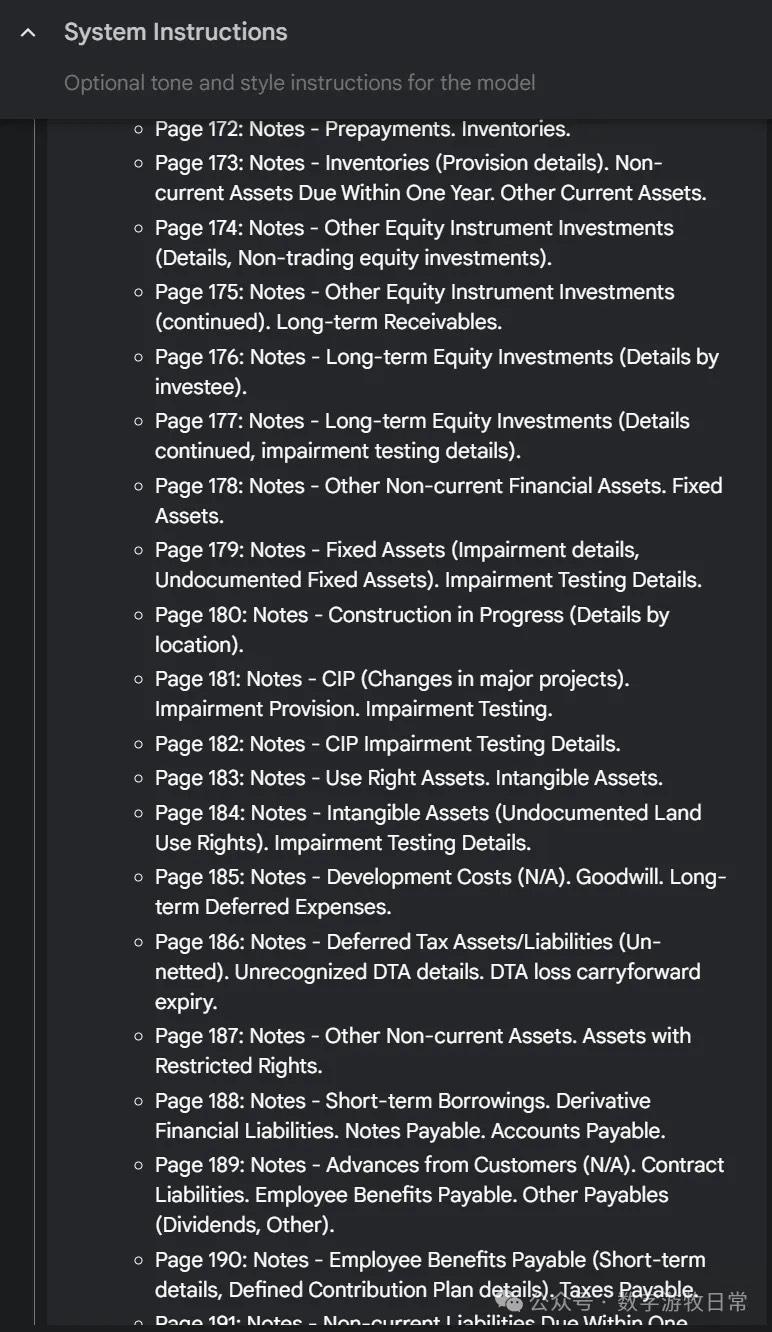

如今,Gemini 2.5-Pro 发布,吸引我的并非什么思考模型,而是 64K 的输出上下文,妥妥的生产力工具大升级。

例如处理一份宁德时代的 2024 年报(超过 200 页)。

思考过程是这样的:

真的是一页页处理:“思考”过去的。

而结果可以到这样的颗粒度:

完整的输出 token 量超过 25K。

是的,就是这么强大,唯一的强大。

当然,完全可以在一个对话里生成一份可交互的分析报告,封面如下图。

不过,我还是习惯性地使用已经固化好的 Claude 3.7 流程来完成。

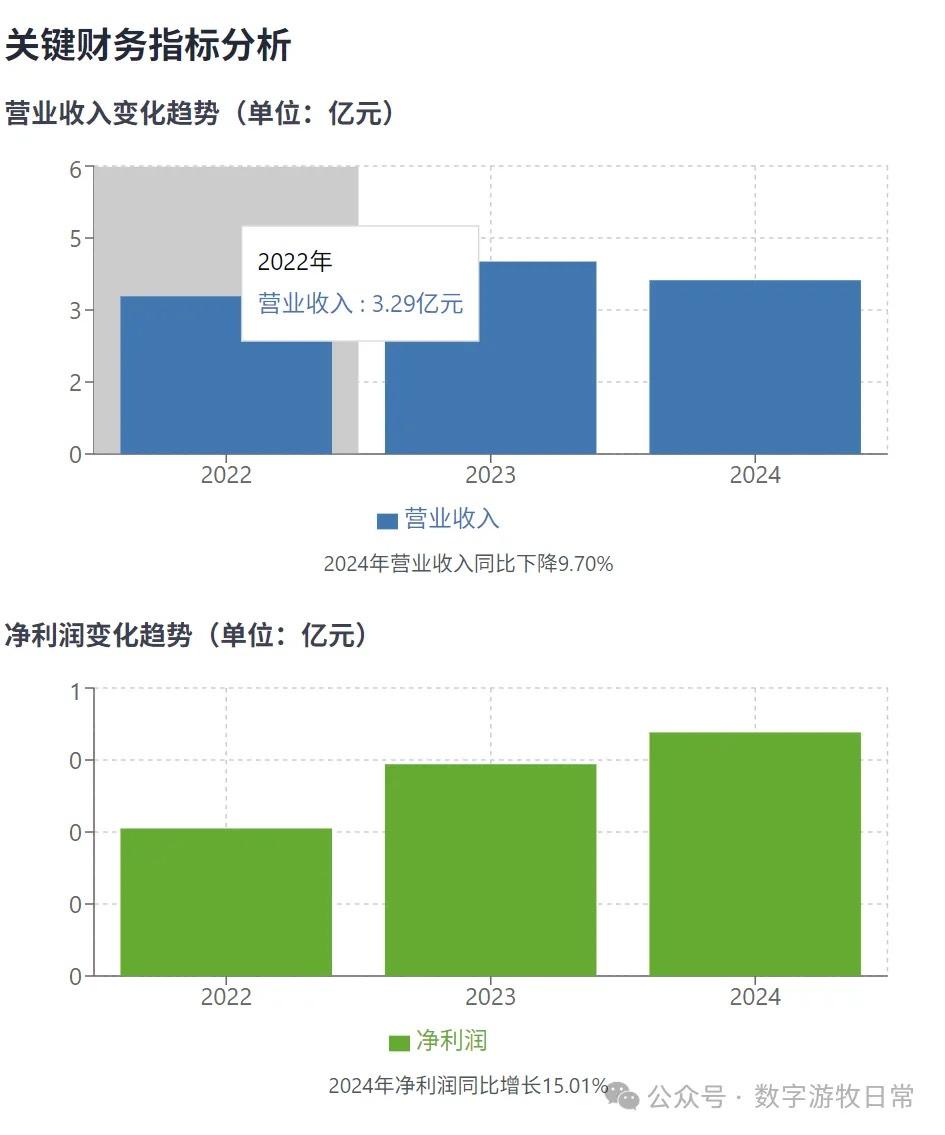

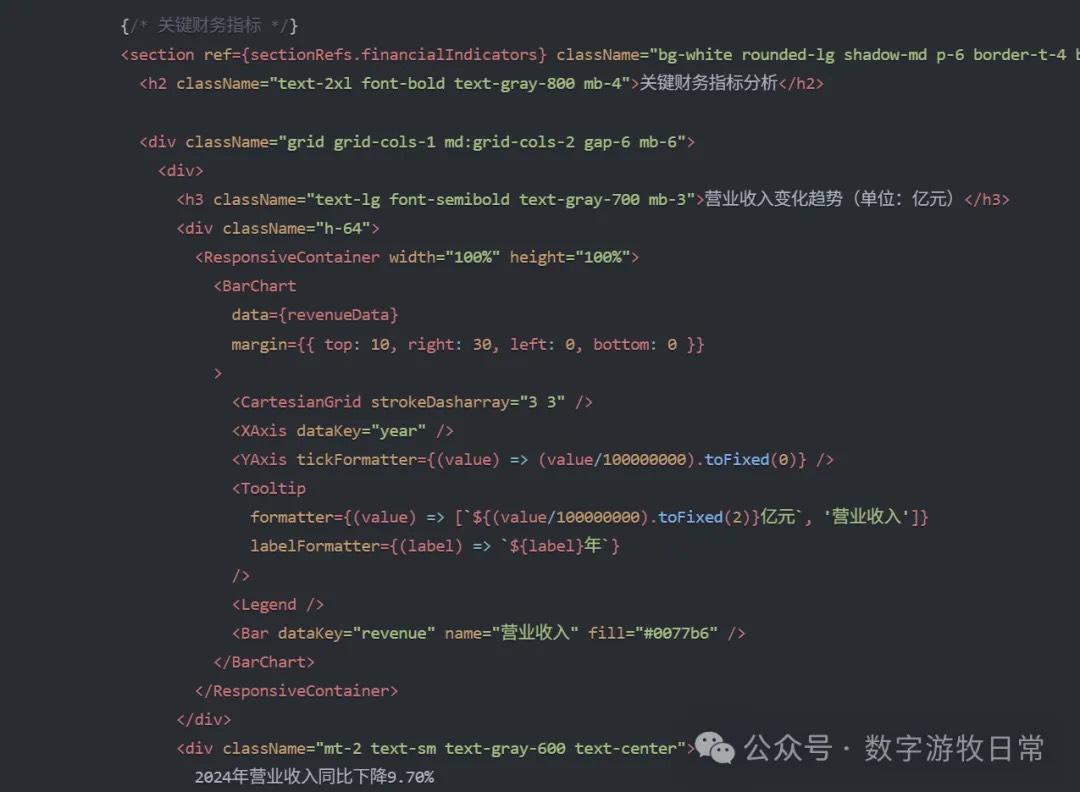

然而,在已经非常成熟的流程模板下,生成结果翻车了:如果按照图表的单位(亿元),那么宁德 22 年收入只有 3.29 亿元?

问题出在量纲,财报里的单位是千元,所以在代码的数据里写了是按照千元为单位的数字,即 22 年收入应该为 3286 亿元。

模型把量纲遗漏了,然后到了图表的代码里,按照亿元来处理了。

挺可怕的错误。当然这个是否能称为“幻觉”可能值得商榷。更大可能还是因为 Claude 3.7 的上下文长度有限。

但是,这也意味着即使是在程序能力上已经如此出色的 Claude 3.7,依然可能随时犯很低级的错误。

当然,在我之前其他的应用中,Claude 也犯过一些其他低级错误,看起来,目前,human-in-loop 依然是非常重要的流程。

是的,模型们每一天都在变好,每一次模型错误与不足的发现,其实都是因为我们又往前走了一步。

是的,那个“万物计算”的世界底层正在快速的坚实起来。