AI对软件行业的“整顿”还没结束,这次轮到安全了,但是逻辑看起来很荒谬,因为荒谬的原因在于Claude本身。

简单而言,因为Vibe Coding的普及,AI交付代码中的安全漏洞呈指数级上升,然后那个造成最多漏洞的Claude模型(不是说它不好,而是它使用最普遍,所以生成的最多,Gemini、GPT,任何模型都在不断制造指数级上升的代码安全问题),站出来说,它可以进行安全防护。

理论上,当然,模型可以干任何事情,但即使我们不讨论模型能力,从逻辑上讲,一个黑盒的模型站出来说可以检测出大量的代码安全漏洞,而事实上很多漏洞都是它制造出来的,难道这不荒谬吗?

我可能是最早公开说AI会颠覆整个软件行业(其实是软件工程)的人,但我的观点并不建立在“模型让软件变得更好”的基础上,恰恰是,建立在“模型更方便更高效,成本低到可以用后即焚”的“预制菜”(其实应该叫预制厨师)基础上。

每个人都可以从自己面临的实际问题需求出发,快速用模型构建出需要的工具,而不再需要等待腐朽的官僚的软件工程的低效输出,尽管软件工程的产品更鲁棒、更可扩展、安全性更好。

但是,完成眼前的目标才是最重要的,在越来越快速变化的时代,谁能讲得清楚明天的需求?

然而,这就是有代价的,代价就是,更低的质量,更多的漏洞和安全问题,不容易扩展(我说的不是全部,是绝大多数,因为底层变了)。

所以,安全问题就是变得指数级上升,当然,很多人并不在意数据泄漏和安全漏洞,但是当指数级上升的应用和Agent任务跑在开放式的互联网上时,安全需求也是指数级上升的。

我一点都不怀疑Claude大幅提升的bug检查能力,不仅仅是Claude 4.6,Gemini-3.1-Pro,Codex-5.3在这方面的能力都是大幅提升的,这段时间我深有体会。

但是,这并不意味着模型可以取代人和成熟工具去进行安全防护,甚至,它们创造的很多奇迹恰恰是建立在人和成熟工具之上的。

我也相信,在可以看到的中短期里,它们可以承担越来越多的安全方面的工作,但对人与成熟工具的依赖也会大幅提升,这个道理放在金融和法律等专业领域也是一样的。安全、金融市场、司法(欧美体系),实质上都是“攻防”,最需要钻漏洞的领域也就是这些,也许模型能够“整顿”这些“投机取巧”,但人类社会可以不断进步在某种程度上不也正是因为这种不遗余力的“钻漏洞”吗?

而且,现在的模型,在知识层面,没有任何一个人可以一望项背,但是,论“聪明”,至少还有段时日。

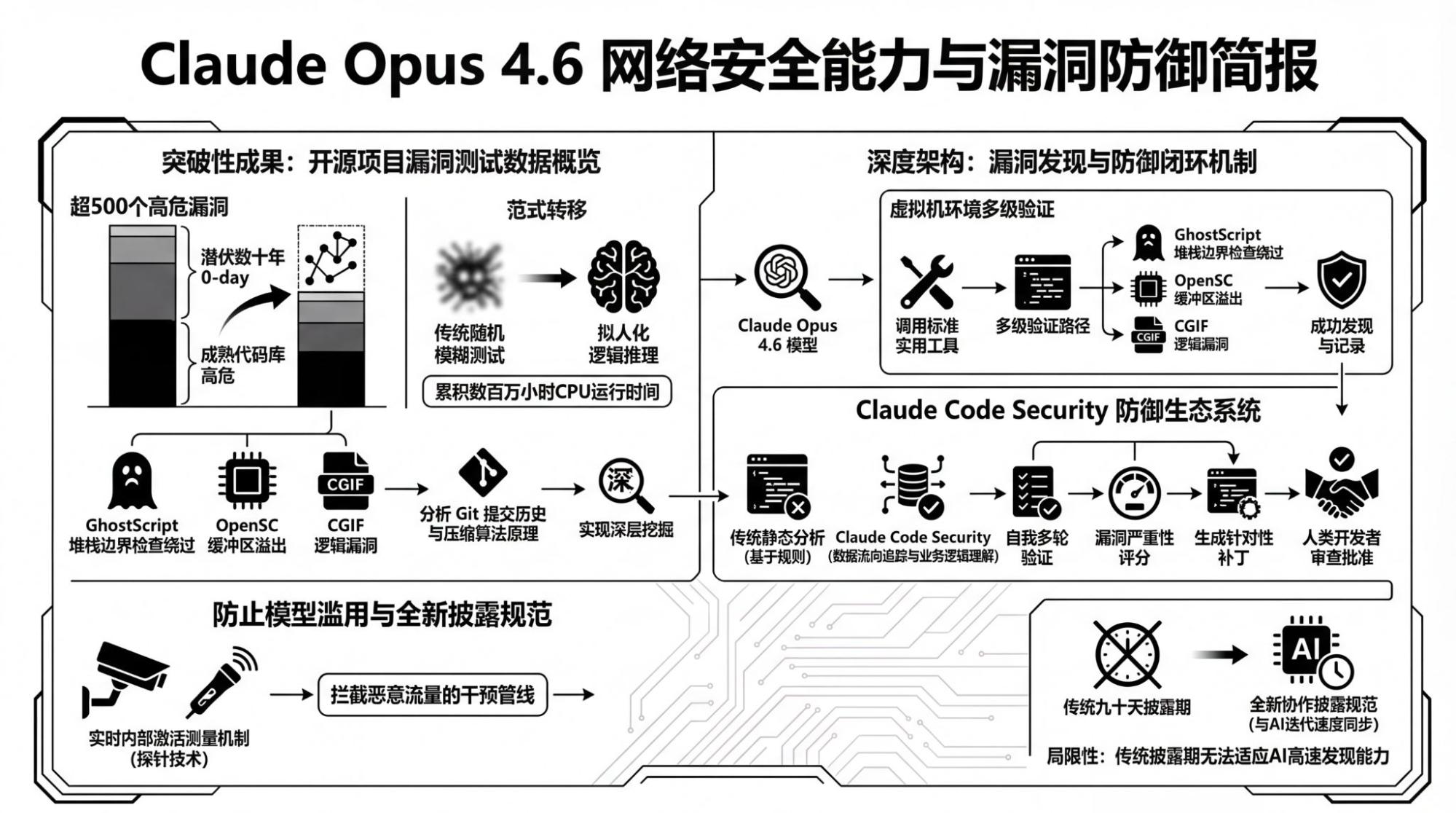

文字写了这么多,该看看Claude到底可以干什么,如下图。

从理性上看,恐慌式的“颠覆各种软件行业”情绪还会存在不短的时间,但是有时候,步子迈得太大了,也不一定有好的结局,历史上这些例子比比皆是。

当然,除非,我们真的正在面临人类历史上最大的拐点,我不知道织布机发明时全社会的情绪反应到底是如何的,那时候没有自媒体,那段时间我们也没有任何一个人亲身经历过。

人类,至今活得都挺好。