过去一周公事私事都比较多,影响了更新频率(预计下周更新频率也不会太高),但是过去一周确实发生了不少事情,所以,快速的过一下。

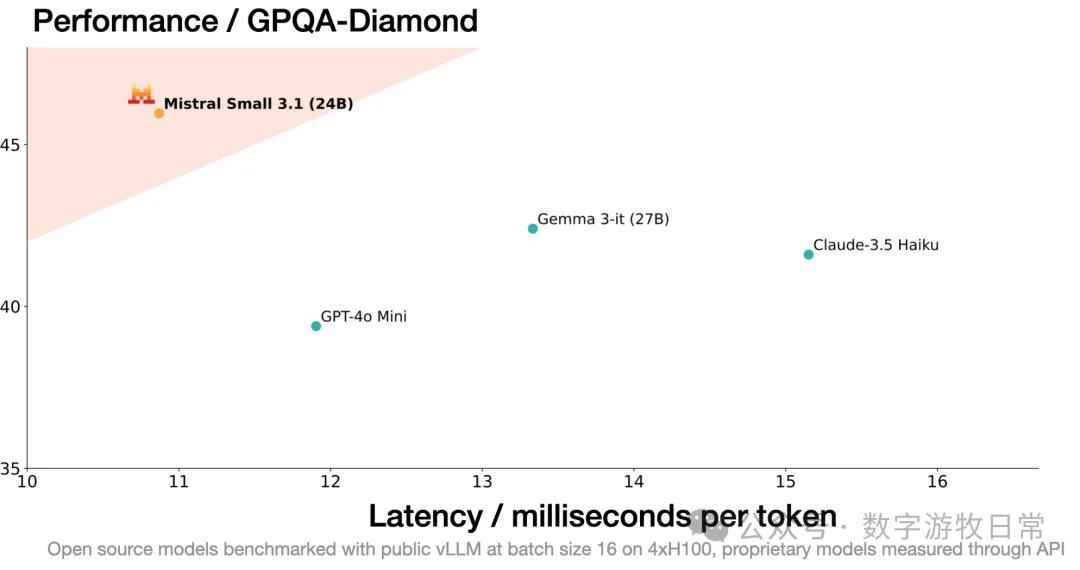

模型层面:主要是两个多模态的:Google的Gemma-3,Mistral的Mistral-Small 3.1,一个面向企业级的:Cohere的Command A。最大参数规模分别为27B,24B,111B,评测结果当然是不一定都超过GPT-4o,DeepSeek-R1,但是一定踩着Llama-3.1 405B。而且,Gemma-3和Mistral-Small 3.1都是可以单卡部署的。

对于这类模型,最大的进步是多模态和长上下文(128K甚至256K),这都是可以创造更多本地应用场景的。至于模型能力,还是那句话,benchmark看看就算了,模型的真实能力,是需要在不断的生产环境中评价和适应的。

英伟达的GTC2025,一句话评价,短期看,当然是不达预期的,但是,中长期是个好事。我在上一篇里面写了部分:一个个“奇点”何时到来,写在英伟达GTC发布新路线图之时

但是这里面夹杂了很多其他的想法,目的也主要是为了自己梳理思路用的,如果单纯总结GTC:

1、未来产品的进展应该是不及市场预期以及去年英伟达给出的更激进的时间表的;

2、但是在Blackwell因为一系列问题不断延期的背景下,这样的路线图也许是更容易被实现的,某种程度上是消除未来的不确定性的;

3、至于所谓“算力平权”,头部的云厂商“身体都很诚实的”,不想多讨论了,我去年下半年开始对英伟达的“谨慎”更多源自于它过于激进的时间表和市场对此过高的预期,如今市场预期下来了,时间表也变得更合理了,就是好事;

4、英伟达的野心就是“唯一的AI算力通用基础设施”,它已经一点都不隐藏了;

5、至于其他软件生态什么的,除了CUDA,姑且看看吧,很多东西也都是跟下游企业一起建设的,不能完全算自己的。

最后,其实Gemini2.0进行了一系列更新:

1、刷屏的Gemini-2.0-Flash加入了图文功能:三个月前说Gemini2奠定Google在2025年的统治地位,看来没说错;

2、其次,Deep Research背后的支持模型从1.5升级到了2.0,在我和小伙伴们测试的很多场景下,其实都超越了OpenAI的Deep Research;

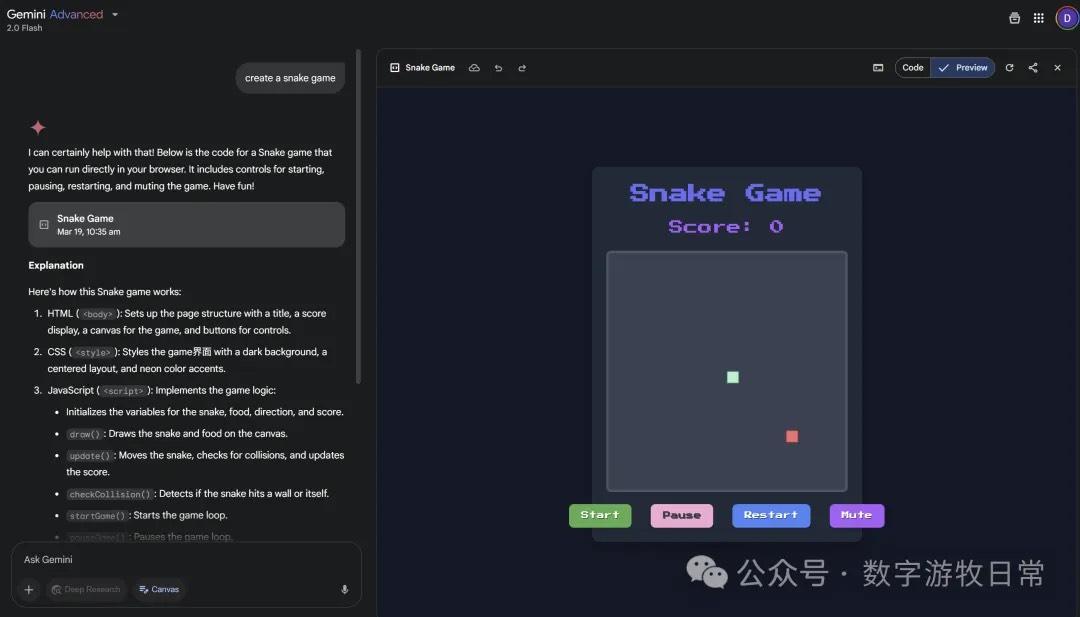

3、加入了Canvas支持,贪吃蛇的画风还是很好的;互动式PPT的风格简洁,但效果确实还不如Claude3.7;

4、还有,就是在Gemini的APP中已经加入了之前爆款产品NotebookLM的语音博客功能:AI Overview;

5、对了,上面提到的NotebookLM中加入了思维导图功能,试了一下,感觉不错。

最后总结一下:其实到了现在,逻辑已经挺清晰了:

开源模型的真正价值是在本地化的场景中,但是本地化场景里最重要的是数据和业务流改造,而不是模型,因为至少开源模型的价值是提效而不是提质;

有算力的(英伟达,Google)是可以任性胡为的;

有前沿模型(OpenAI、Google,Anthropic即Claude)的,是越来越走向All-in-One的直接生产力工具的,“套壳者”的目的或许都是被收购;

所有产出质量的提升都归结到两点:人,数据,其实就是“私有数据”。