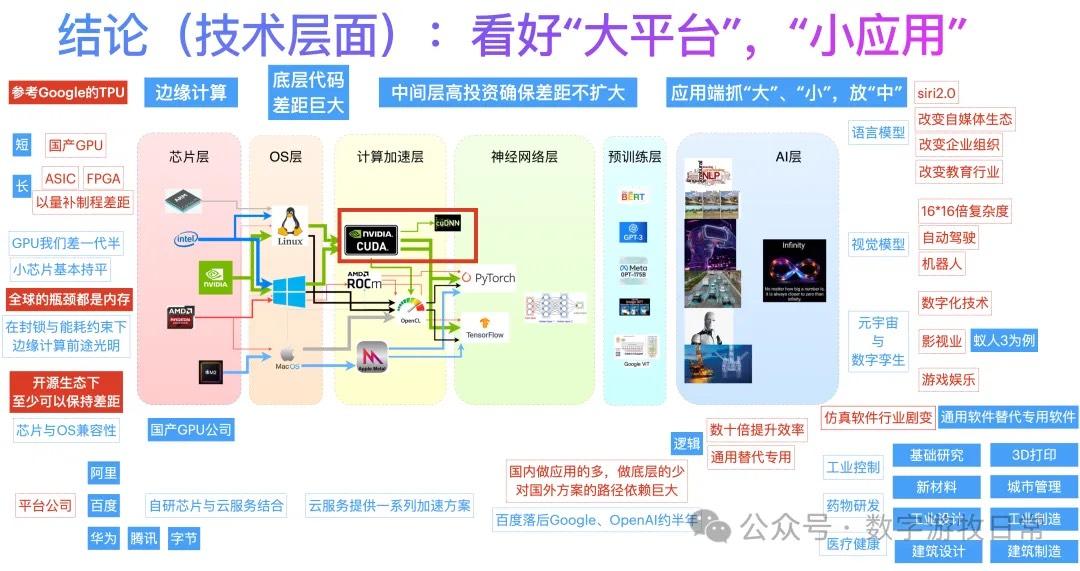

上图作于整整两年前,在ChatGPT刚火之时。23年上半年线下交流时,都会先拿出这张图。

两年过去了,AI行业早已发生了天翻地覆的变化,可如果再回来看的话,似乎要我改变的结论并不多:

1、我一直认为开源社区不会被闭源模型差距越拉越大,相反,开源达到闭源同等能力是迟早的事。DS横空出世似乎验证了,虽然在严肃场景下,我不会选择幻觉率偏高的DS,但是在基本能力上接近最好的模型也已经成为共识;

2、硬件上,内存带宽而不是芯片算力本身是最重要的约束条件。这是大厂不断推进in-house的基础;

3、市场上,最终不会缺模型,而是缺场景,而是要不断降本:有强生态的云或许才会是笑到最后的;

4、在各种原因的共同作用下,国内格局的变化远大于海外,我看好的某巨头终于“急速坠落”了,或许还会有一些翻身机会,但这是我当初最错误的判断;

5、多模态才有更大的未来;

6、独家模型、生态、规模效应、低成本、灵活性,这些至少要占一两条吧,夹在中间其实很不舒服;

7、其实模型在具体产业里的落地进度是比预期要低很多的,看起来具体应用里数据积累和流程再造,不是短时间可以完成的;

站在当前时点,很像一个熟悉的周期再来一次:

1、基础模型又成为最重要的竞争点了;如果把DS看作语言模型突破赶上的话,下一个该是多模态了吧;

2、影响应用落地的三要素,模型能力、低成本、生态场景(数据准备),看起来指针转到了低成本和生态场景上;

3、与两年前很大的区别是,那时候模型收费的前景很广阔,如今,一方面是开源,另一方面,其实真正达到DS-R1能力部署的推理成本并不低,而收费天花板已经被压制了;

纯通过买服务器,卖推理API的云服务,估计成本都难以覆盖。只有两种方式降低成本:足够多的自研芯片(例如Google TPU的体量和成熟度),足够强大的生态场景支撑。

云,越大越好。