Rabbit美东时间4月23日晚八点,Rabbit R1在纽约TWA酒店举办了其新品提货活动,活动上,公司创始人Jesse现场展示了r1的UI,操作逻辑和功能。

Fig 1 Rabbit r1产品外观

就产品本身而言,我们认为r1是一个有一定使用价值的,同时也是一个有趣的产品。操作逻辑非常优秀,接近于古早iPod的操作逻辑,但丝毫不会让人觉得过时。

Fig 2 摇晃进入设置菜单 Fig 3 右侧滚轮选择项目 Fig 4 滚轮切换摄像头方向 Fig 5 打开Terminal模式后横置激活键盘

Fig 6 滚轮可用于横向选择和移动光标

当然,Rabbit r1的主要操作并不是通过物理上的触控实现的,而是通过语音交互,Jesse展示了几个r1的基本功能。首先在基本的搜索功能中,Jesse问了一个简单问题和一个复杂问题,分别为:

Q1(英): What's the current weather in los angeles? Q1(中): 洛杉矶当前的天气如何?

Q2(英): Who won the 2011 Formula 1 Drivers' Championship, while you are at it, who is the designer of the car that won the championship? Q2(中): 谁是2011年F1比赛冠军,顺便帮我查一下谁是当年夺冠车辆的设计师?

针对这两个问题,r1都给出相当准确的答案,并且配合有语音播报。在第二个问题中,r1不仅回答出了正确的车手和车辆的设计师,还给出了设计师的额外信息。

A2(英): The 2011 Formula 1 Driver's Championship was won by Sebastian Vettel, driving for red bull racing, the designer before the car that won the championship was Adrian Newey, who has more than 20 Formula 1 world championships to his name, when you combine both drivers and constructors titles. A2(中): 2011年一级方程式赛车车手锦标赛由塞巴斯蒂安·维特尔获得,他当时效力于红牛车队。设计这辆夺冠赛车的是阿德里安·纽维,他的名下共有超过20个一级方程式世界冠军头衔,包括车手和车队的冠军。

但不得不忽视的一点是,r1的响应速度并不快,在天气问题中,在Jesse完成提问后,大约五秒后才返回答案,我们认为这可能有两方面的原因,首先r1目前只支持4G LTE网络,另外,r1的计算并不在本地,而是通过调用第三方API来获取答案,那么答案的获取速度势必会受制于第三方API的运行速度。

说到API,目前r1已经支持了OpenAI,ANTHROPIC和perplexity三大LLM厂商,考虑到r1是一台售价为199美金且不向客户收取额外订阅费用的硬件产品,集成这三大API不可谓不良心,但换个角度来说,r1是没有自己核心的人工智能能力的,Rabbit r1现在所做的只是集成。

Fig 7 r1当前支持的LLM API

图像识别和OCR是Rabbit r1的一大亮点,不是说它相比现在的主流智能手机好,而是比我们预期的水平好,毕竟这个售价仅为199美金的设备的成像质量能有多好呢?但r1对图像的识别正确率是在线的,这得益于现在图像识别算法越发成熟。

Fig 8 r1使用背后摄像头拍摄

值得一提的是,在图像识别的第二个演示任务中,Jesse要求r1识别一张手写的表格,并且转换其中两列的位置,r1成功完成了这个任务并且将电子表格传到了Jesse的邮箱中。最终r1能够将电子表格传到邮箱的动作意味着r1赋予了用户定义工作和数据流的权限 and 能力,是个不错的设计。

Fig 9 处理完成后表格自动发送至邮箱

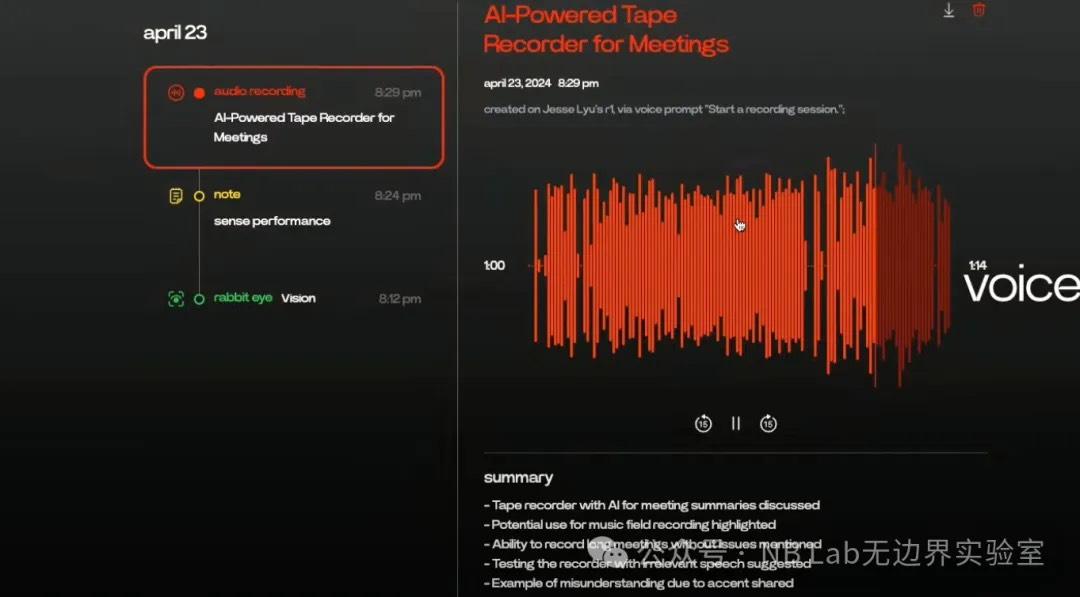

之后,Jesse展示了r1的笔记功能,简单来说就是语音转文字和音频录制,比较亮眼的是Rabbit为r1匹配了一个名为rabbit hole的笔记平台,可以记录笔记内容和时间轴,并且在平台内嵌了AI分析功能,就现场演示的表现来看,我们认为音频要点梳理的表现并不非常理想。

Fig 10 r1 笔记平台

LAM(Large Action Model)是r1比较核心的功能,简单来说就是通过语音操纵应用,Jesse首先展示了最为简单的音乐播放功能,r1对此请求响应极快,一秒钟之内就在macos上打开了spotify软件并播放音乐。接下来Jesse演示了逻辑更为复杂的点餐功能,Jesse表示该功能不通过任何api或者sdk实现,而是全部通过大语言模型理解自然语言并执行命定,他同时提到这个模式的一大缺陷就在于功能实现的速度是受制于点餐平台的处理速度的。在实际的演示中,r1在第一次并没有成功识别Jesse购买麦当劳的请求"Can you get me McDonald for food please?"仅仅跳转到了Doordash的首页。在第二次Jesse更加明确地表明他的诉求后"Let's go to McDonald.",r1才正确操纵网页到达了麦当劳的点单页,但耗时非常长,约为十秒钟。在选择完成后,所选订单显示在了Doordash的购物车中。

Fig 11 r1 麦当劳点餐界面

值得注意的是,Rabbit似乎专门为Doordash专门设计了UI,在之后的Uber应用中,我们也看到了重新设计的UI。

Fig 12 r1 Uber下单界面

这可能意味着r1上所有的LAM应用都需要经过再开发,而在一个这样的"异形"设备上,我们认为操作逻辑可能会是影响开发效率的一大障碍。同时,产品早期配套LAM的应用的开发进度也将是影响产品易用性和软件生态的一大因素。

和Large Action Model配套的是Teach Mode,我们认为这是rabbit r1最为重磅的功能,也是最具创新性的功能,Teach Mode本质上是希望用户不断地为r1提供训练集,而训练集中的自变量和应变量就是每个特定行为的名称和该行为的具体操作。现场展示了一段如何训练r1在Amazon上选购手机的操作,首先用户需要在右侧Task Description中描述当前的任务,在这个案例中,是选择蓝色128GB iPhone14并添加到购物车,然后再在网页上执行这个操作。

Fig 13 r1 Teach Mode

Rabbit的愿景是通过的大量的训练来使模型成熟,类似于特斯拉使用用户数据训练FSD,我们认为这是一个极其有意思的想法,但是对此r1在这一方面的成功并抱太大希望,r1似乎是想仅仅通过图像就理解网页的操作逻辑,我们认为这是可行的,但所需要耗费的数据量和算力无疑是巨大的。就目前的演示效果来看,Teach Mode的表现并不理想,Jesse也表示上半年Teach Mode并不会开放给所有用户使用,将仅限于测试用户。

Fig 14 Teach Mode批量训练

大体上,Rabbit r1作为第一款AI硬件,产品本身而言,它绝对是优秀的,但它的壁垒并不高,正如刚才所说,r1并没有核心的人工智能能力,r1是人工智能API的集成,底层的人工智能能力并不是它的核心竞争力,199美金的价格且不收取额外API订阅费用才是它最大的竞争力。

看完发布会之后另一个最大的感受就是,在智能手机面前,r1在一定程度上是多余的,请注意,是一定程度上。所有r1的功能在硬件层面上都能在当今的主流智能手机上实现,但未必有这么优雅,当这些功能迁移到手机上意图将一台传统手机变为AI Phone的时候,由于底层系统的臃肿,势必将更加笨拙。我们一直认为真正的AI Phone并不是所谓的文生图,文生视频,而是手机内部存在一个agent帮助你自动化地去处理一些不那么标准化的任务,就比方说Teach Mode中的亚马逊买手机案例,而当把要求提升到这一层次,只有苹果才有这个能力,因为它足够一体化(控制底层系统的能力),而且它有足够的用户规模(数据)。

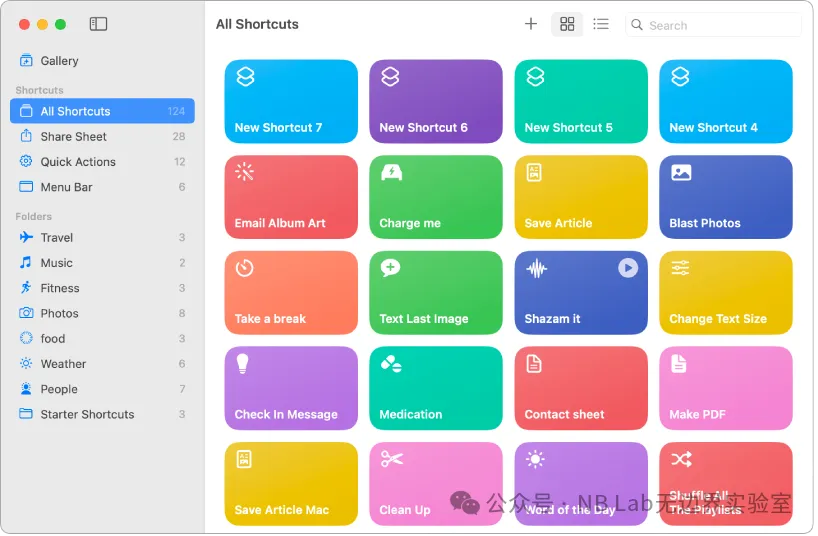

Teach Mode其实很像苹果的一个应用,Shortcuts快捷指令。快捷指令(Shortcuts)是一种强大的自动化工具,专为iOS、iPadOS和macOS设计,使用户能够通过自动化复杂的任务来提高效率。通过这个应用,用户可以创建一系列自动化操作,这些操作可以用简单的触发动作来启动,比如触摸一个按钮、到达某个地点、设置的时间到了或者通过Siri语音命令。

Fig 15 iPad预设快捷指令

Teach Mode所要训练得出的结果,其实就是快捷指令中的内容,但快捷指令不是训练得到的,而是用户编辑的,快捷指令可以理解为已经标注好的数据集,那么其实反过来多年以来快捷指令中积累的众多指令是可以用于训练苹果自己的Teach Mode的,这一点可能苹果当年也没有想到。

即便不存在快捷指令,苹果仍旧是最有希望实现Teach Mode这种最为直观的训练方式的那一个,因为苹果掌握iOS系统的最底层,在用户眼里,他们只是给系统输出了视觉上显性的操作逻辑,但实际上苹果能够通过iOS读取最底层的操作逻辑。那为什么不是Google的Pixel?因为用户数量太小了,能够使用的数据量相对苹果而言是相当有限的。