Cohere在4月4号发布了新的闭源模型Command R+。

当然,现在敢闭源的模型,基本都要达到甚至超过GPT-4,最好,API调用成本还低于GPT-4。

这点,Cohere差不多做到了,至少按照自己的表现评分看。

这个模型有几方面特色。

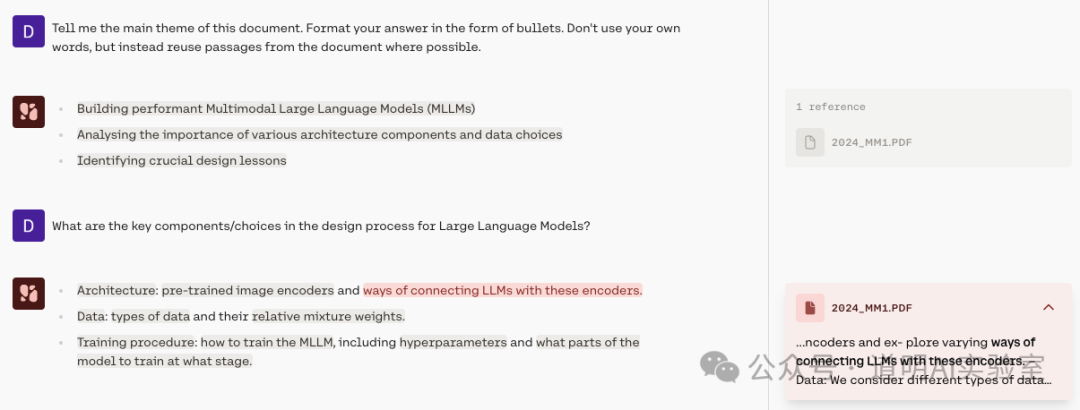

首先,是带位置引用的高级版RAG(Retrieval Augmented Generation),用来消除“幻觉”。我试了一下,如下图,左边对话结果里淡灰色背景的文字部分都是从文档里找出的部分,点击后,右边可以直接有出处。实话说,这个对于现在的RAG而言,基本上不算是新功能了,但是如果换一个角度考虑,如今模型应用于文档处理的渗透率其实非常低,这种功能的整合还是会推动很多应用加速渗透的。

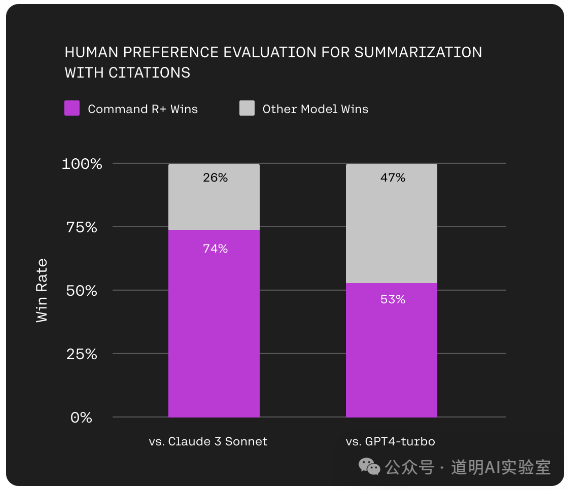

在用户主观盲选的测试中,Command R+略胜GPT-4 Turbo。可惜没看到跟Claude 3 Opus模型的对比,毕竟这才是现在最好的正式版模型。

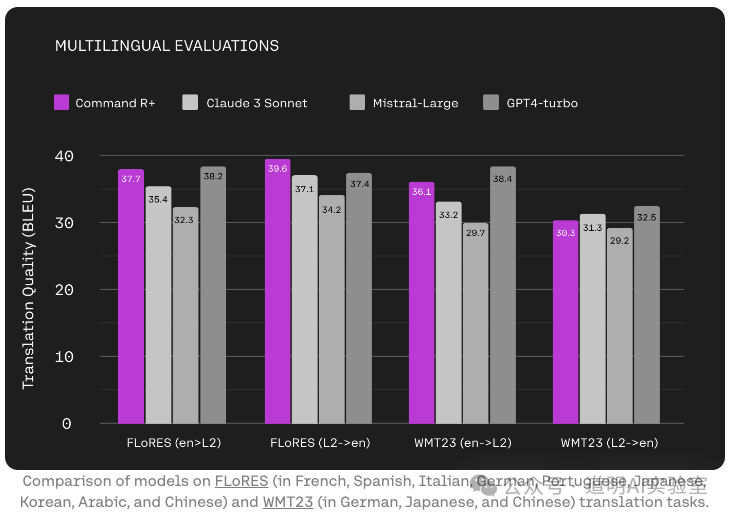

Command R+模型的第二大特色是:多语言能力。其实,在Sora发布时,Cohere发了一个开源模型Aya,依靠全球差不多3000位独立研究员的共同努力,得到非常优异的多语言能力表现。有这个基础,放到闭源模型里,多语言能力应该是在预期之中。

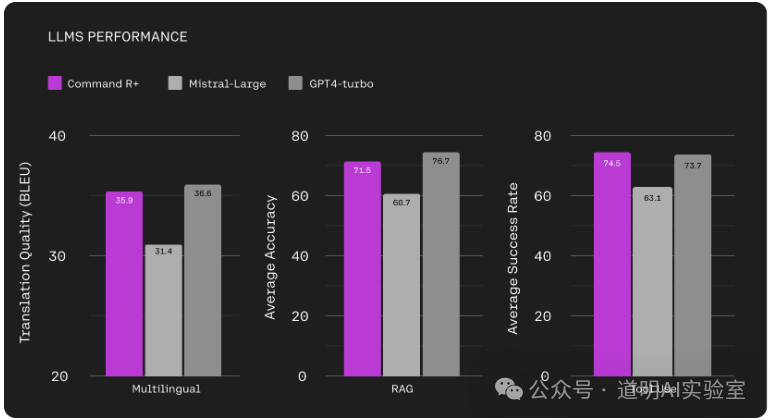

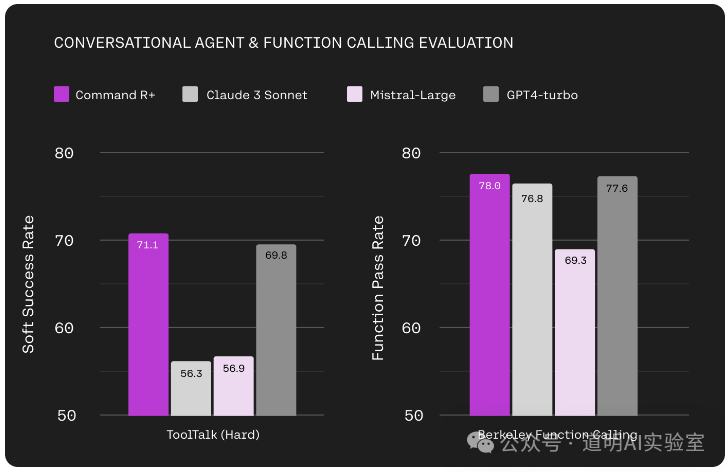

第三个特色,就是适合商业应用场景的复杂工具调用能力。其实自动化的工作流和“函数调用”的应用场景非常多,也是AI落地的一个重要基础。Command R+超过GPT-4 Turbo的表现,还是非常优异的。

这就是一个完全面向企业端的模型,当然,也是第一时间跟微软Azure云合作,Azure云用户可以直接调用模型。

这一轮AI,最大赢家显然是英伟达,其次,就是云服务企业了。微软似乎也在去年OpenAI管理层震动后快速调整了策略,与Mistral的合作,合并Inflection,现在又第一时间与Cohere合作。MaaS(模型即服务)的商业模式看起来开始清晰了。

Cohere的Command R+模型其实提出了两个问题:

1、模型提供给谁?企业,这个答案很清晰。 2、当能力达到了,最重要的是什么?使用成本。

所以,相比于模型本身的能力,用户使用成本和实际推理成本,成为模型间竞争一个非常重要的关键因素了。

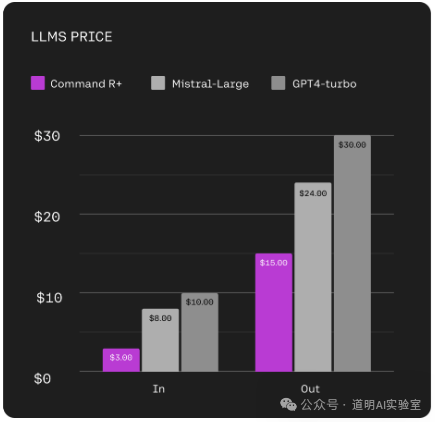

首先,如果按照每百万token的使用费看。Command R+的输入成本只有GPT-4 Turbo的30%,输出成本是50%(如果考虑企业应用往往输入端上下文更长,那么综合成本是低于50%的)。

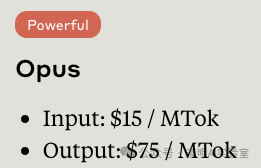

目前最贵的模型也不是GPT-4 Turbo了,而是Claude 3 Opus。输入和输出分别是15美金和75美金,每百万token。

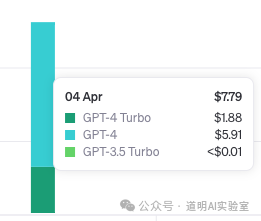

其次,看起来,模型还是一门很挣钱的生意,昨天,我只是试了一下OpenAI刚刚开源的Transformer Debugger,几个例子就花了接近8美金。

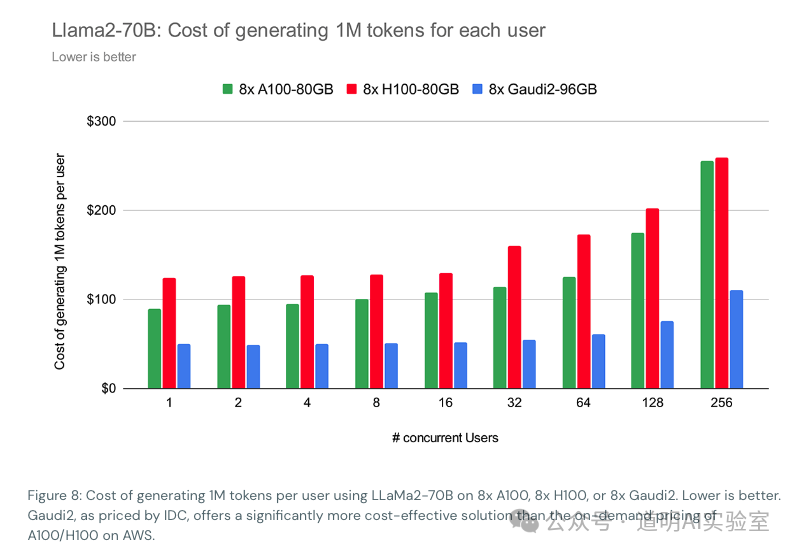

但是,如果参考Databricks的计算,即使使用Llama 2-70B模型推理,每百万token的推理成本也超过100美金(按照云服务器租赁价格计算)。

我相信,大模型公司的推理成本会比这个显著低,但是非常大的概率,模型公司的token费用是覆盖不了推理成本的。

推理成本的竞争才开始,这个竞争既是模型公司的,更是芯片公司的。