也就是上周,ChatGPT插件功能正式关闭,距离2023年3月23日的发布,差不多一年时间,但是考虑到实际开放是在2023年六月,ChatGPT插件的寿命大概是九个月。

OpenAI对外的解释是,插件功能已经可以被GPT商店完全取代了,所以,正式关闭。

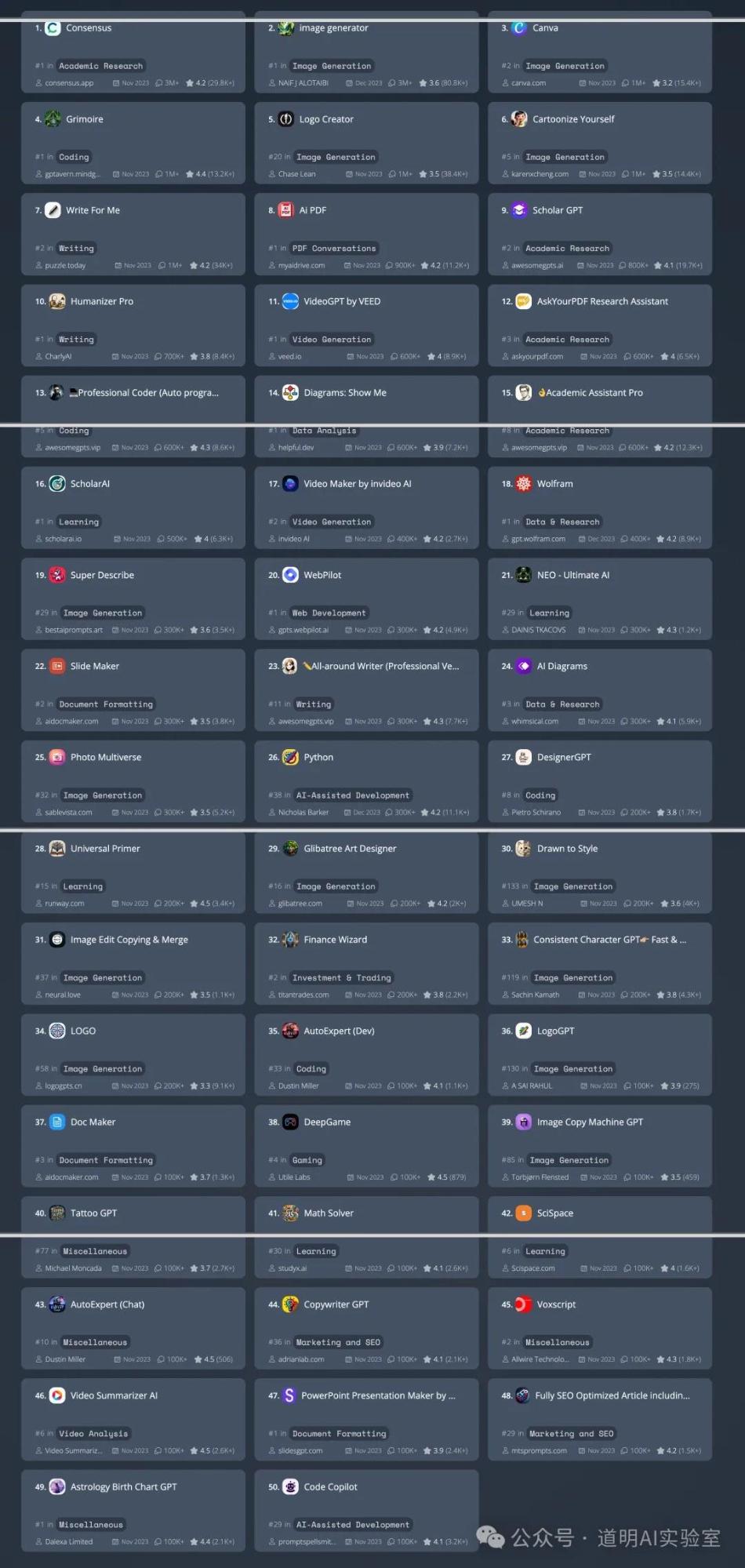

可是,如果细看昨天引用的来自whatplugin.ai统计的GPT商店数据的话,情况并不像OpenAI所说:即使排名第一的Consensus GPT,对话数量也只是超过300万,与OpenAI六七千万的日活数完全不在一个数量级。

真实的情况或许是,即使是GPTs,也并没有火。

插件出来时,我曾经很兴奋的说过插件的优点,并且写了个小插件方便处理一些数据;GPT商店出来时,我也做了几个GPTs,同样是为了方便处理一些数据。

如今这样的结果,大出当初的意料,可是想来,也是合理的。

我们需要ChatGPT这样的生产力工具,也需要那些可以增强模型能力的辅助工具。

然而,使用的人再多,ChatGPT也无法成为流量入口。流量始于GPT,也终于GPT,这其实是AI应有的样子:闭环。

我们依然还习惯于用“互联网思维”来分析AI和应用。但是,正如,移动互联网跟互联网实际不是一个物种,AI与移动互联网也不是同一个物种。

其实,无论是插件,还是GPT商店,都代表着一个巨大的机会:所有关于信息处理的工作都值得用大模型再做一遍,而基座模型强大后,再做一遍的成本理论上是极低的。

所以,我们看到,当插件刚推出时,文档处理的插件变得很有用,解析PDF,由大模型“学习”后,成为知识库。现在最流行的GPTs依然跟“知识库”密切相关。

可是这些“外挂”存在的前提只是在大模型的能力边界还未触达时。当GPT-4支持文档上传功能后,收费的PDF解析插件几乎瞬间宣告“死亡”。移动互联网时代,开发者使用的可能只是平台流量,产品核心竞争力在于自身;AI时代,开发者使用的是平台(如果还可以这么称呼的话)能力,却也是产品核心竞争力。然而,这似乎也带来了一个悖论:如果产品面对的需求是真实的,那么也是大家希望大模型可以“原生”支持的,大模型也一定可以“原生”支持的。

或许,在AGI出现之前,我们需要的只是这样的AI:1、降低甚至完全取代“我”对别人的依赖,却不影响别人对“我”的依赖,“卷”别人“不卷”自己;2、可以付钱订阅模型服务,然后取消对其他工具的订阅,降低成本。