我本来在写关于CES2024的观点,但是一个产品突然跳到了屏幕上:Rabbit R1。

只是看到这个样子,我预感到“不妙”:这也许就是2023年我们一直都在讨论的AI硬件的可能形态。

你可以把它看作一台手机,因为它可以插入4G Sim卡,你也可以把它看作一台基于大模型的盒子,它具备浏览功能,交互功能,可以拍照。

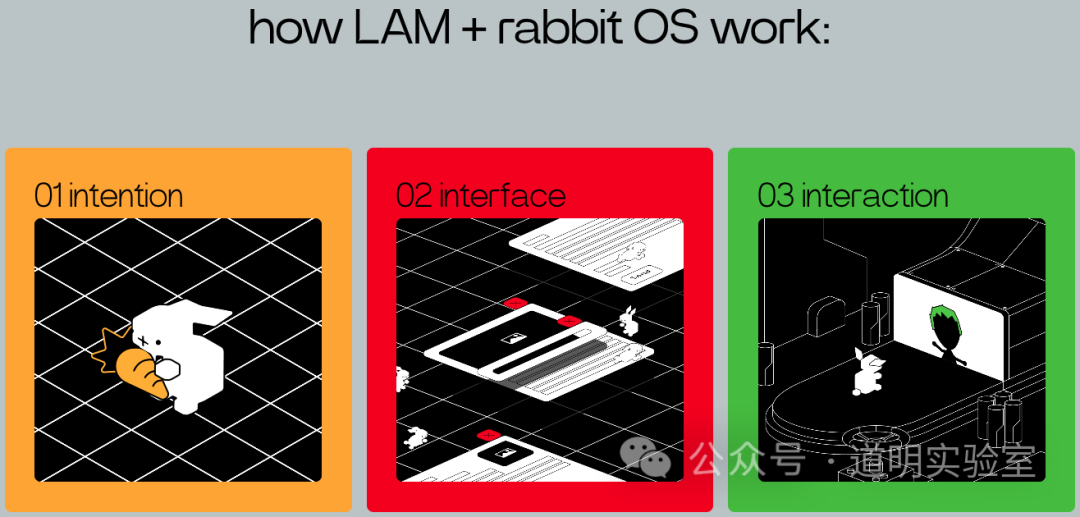

这个产品是一家叫做rabbit的初创企业刚发布的,基于被叫做Large Action Model的大模型,通过叫做rabbit hole的portal,即可配置各种功能。例如,spotify播放音乐:

例如,看行情:

我一直认为,当AI进入硬件时,因为交互方式的改变,所以需要的是全新的操作系统。

如果仅仅是这些,我只是觉得可以,199美金的价格也不贵,小巧,颜值高,新交互方式,很好的玩具。如果可以集成社交媒体的功能,那么就完全可以替代手机了。

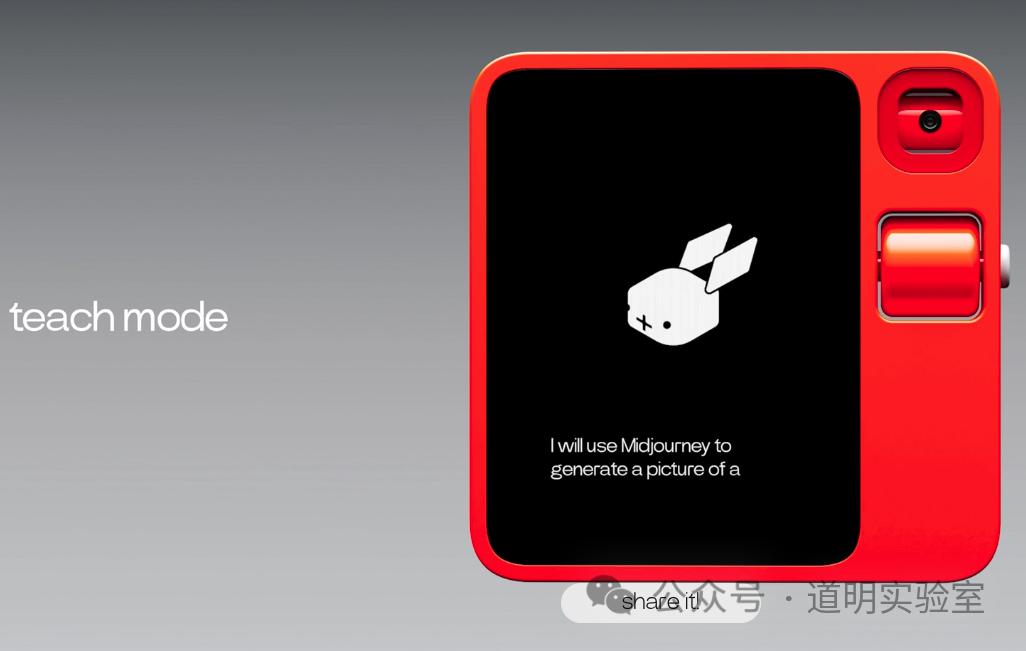

但是,它显然不止这么多,因为有一项叫做“teach mode”的全新功能,这种功能我曾经设想过很多次,并且在桌面系统里进行了一定的尝试,但是当我看到介绍视频里这项功能被搬到这样小巧的硬件中时,我还是“哇”了起来。

这项功能在官网的介绍视频里演示了超过三分钟,感兴趣的可以去rabbit.tech观看。

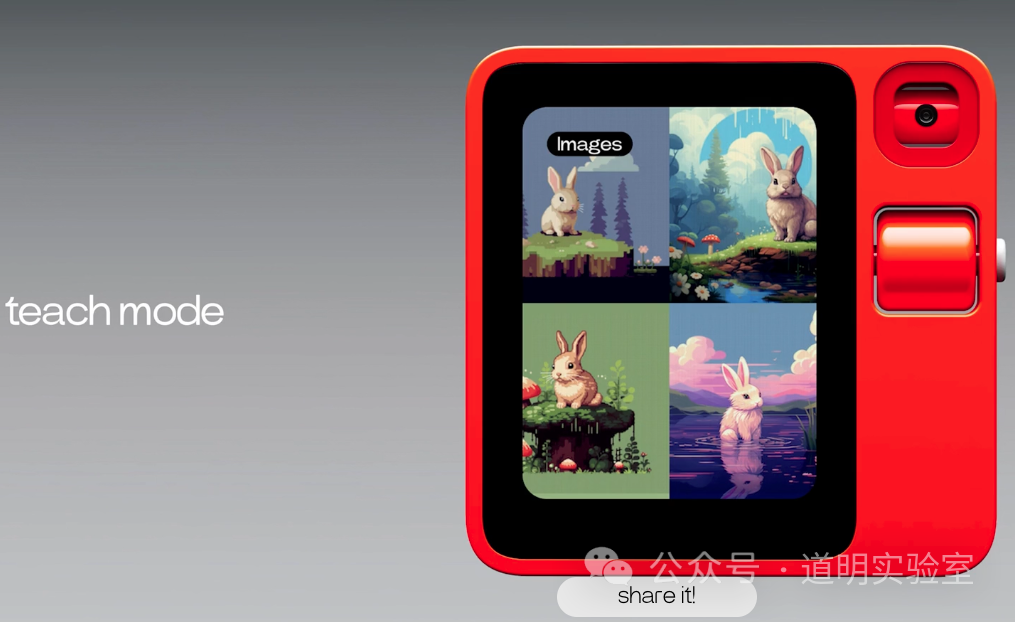

我这里简单描述一下这项功能:我们在电脑上做一遍通过Midjourney生成图片的完整流程,然后保存提交,然后,就可以不通过电脑,只通过这台r1,就可以使用Midjourney文生图了。

是不是就是Office里的“宏”?但是显然比“宏”强大很多,因为有大模型的支撑,生成的是某种智能化的模版,而不是设定死的机械动作。

我能想到的,回邮件,打游戏,知识库的归档,太多能够做的事情了,如果真的“教一遍”,就可以都交给这个小“玩具”去自动处理,我们就真的有更多时间去亲近自然了。

显然,第一代的产品一定还有很多瑕疵,但是,在2024年的一开始就能看到完成度如此之高的“未来”,新的AI硬件,可能颠覆手机和PC的那种,依然让人足够兴奋。

属于软硬结合的AI的2024才开始,精彩也才开始。