我想了几个标题,都觉得过于惊悚,惊悚到差点放弃写这一篇,与朋友的简短交流,还是驱使了我要继续写下去,同时,尽可能增加篇幅,使他显得完整一点。

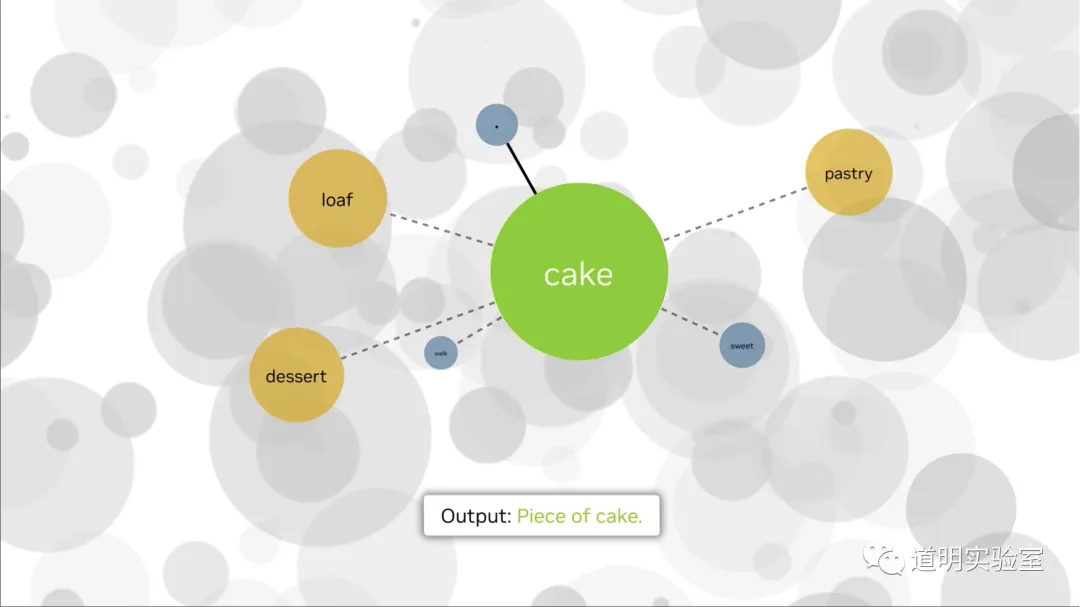

在ChatGPT刚🔥那阵子,我介绍简单原理时说过,GPT的原理是通过概率猜测下一个词(严格的来说,是Token,但是通俗其间,我还是用“词”),OpenAI的想法是“能否通过不断猜测下一个词来理解人类的语言”。

ChatGPT几乎做到了,这也是生成式AI的基本原理:通过预测来理解。但是意外的副产品是“生成式”本身却渐渐成为了一个所谓的“超级智能体”,我们看到的文生文,文生图,文生视频,文生音乐,开始喧宾夺主,俨然一副要从“客体”逐渐成为“主体”的架势。

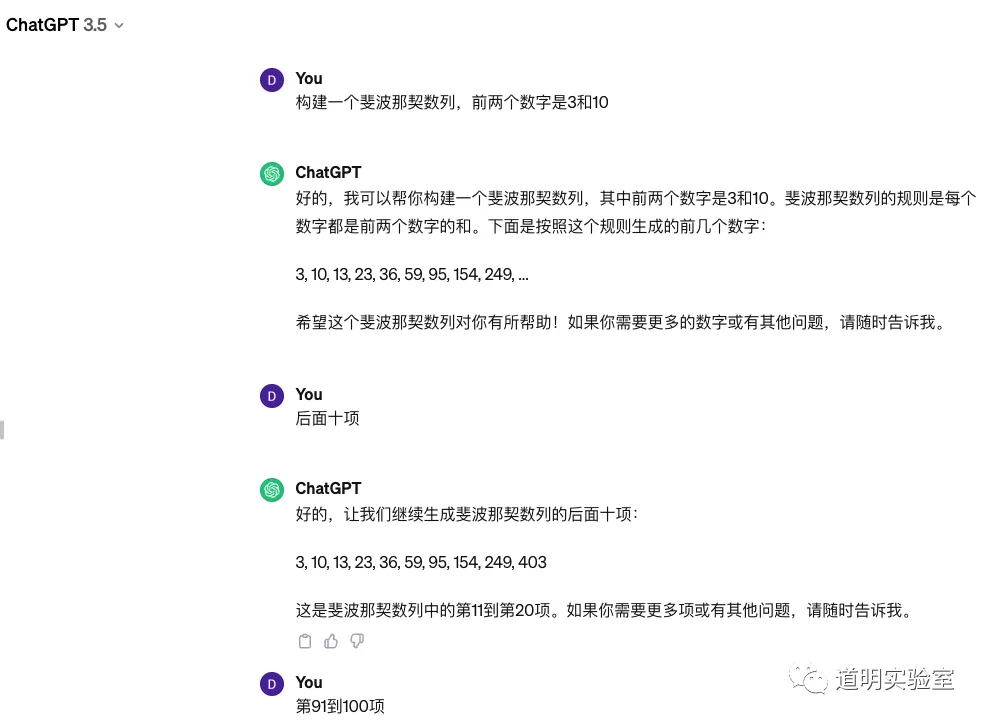

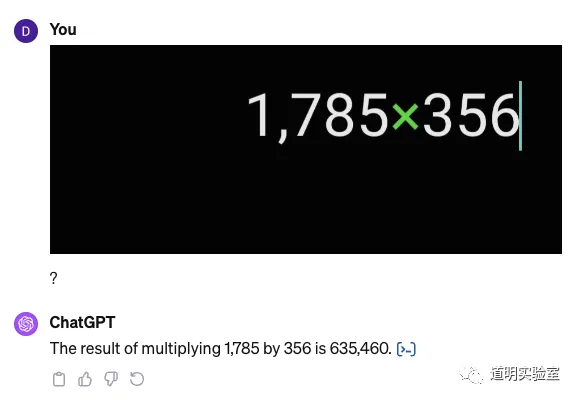

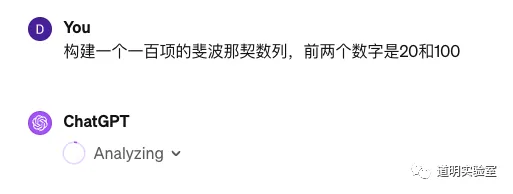

但是当时,我也说过,虽然可以生成,但是其实Chat不知道自己说的是什么(部分可以理解为大家所说的“胡说八道”),它不理解数字,不理解时间,更不理解空间。当时,我也跟朋友进行过很多的深入讨论,找了很多例子,一个例子就是它并不能正确地生成斐波那契数列。

(因为我已经找不到当时用的例子了,所以临时用一个当下时点的“ChatGPT-3.5”的聊天记录替代)

显然,3.5已经比我当时记忆中的模型有了巨大的进步,至少看起来前十项是正确的。

但是也显然,91-100项是错误的。

这依然可以很好的支持我当初的观点:它不理解数字本身,要理解这背后的算法原理稍微费点脑子,就比如,在GPT的模型中,1122334455并不是一个完整的数字或者“字符串”,而是可能被拆成了“1122”,“3344”,“55”,或者其他形式,所以在生成式,它只是通过概率知道“1122”后面更大可能性是“3344”。

如今,知道这一点的人已经越来越多了,甚至当初质疑我这种解释的人,开始反过来问我:我们都知道其实GPT不会做数学题,那把它用在专业领域,怎么可能超过人?(无意冒犯,也不需要任何对号入座,在可见的很长时间里,我们都不会真正知道模型的完整原理,即使我支持模型开源,我也不相信代码会开源,更不支持代码开源,所以,LLaMA2这种尺度正正好)。

GPT也不理解时间和空间,所以,我也确实讨论并回答过为什么需要具身智能(Embodied AI,人形机器人只是这个领域很小的子集)的原因,当然,我没讨论的是为什么我认为大量的Synthetic Data(大概可以理解为由模型自己产生数据,优化自己,注意,我没有用“训练”)是重要的。但是这个话题不属于我这篇要讨论的范围,所以到此为止。

言归正传,为什么GPT不懂数学这么重要,或者换个说法,为什么AI会做数学这么重要?(我知道,很多人又要挑战了,不是GPT已经通过了很多考试了吗,为什么会说他不懂数学?我想举个不恰当的例子,我们碰到作业里不会的题目,上搜索引擎搜了一下,做对了答案,那么是我们真的会了吗?GPT可能可以做对,但是它还是不会,并且,它不知道它不会,后面一点可能更重要,下面会说到。)

因为如果一个AI真的可以做数学了,哪怕是很简单的数学题,这就是一个最重要的0到1,甚至就可以称为普通AI到AGI(通用人工智能,对,我们很多人想象中的无所不能的存在)的跨越。

所以,为什么昨天自媒体上爆出来的OpenAI的“Q*(Q星,Q-Star)”那么让人震撼的原因。(按照目前的信息看,Q大概是Q学习和A搜索的结合体,Q学习就是用在我们知道的人类自反馈增强学习中的,就是怎么使得GPT说起来像人话的那个关键部分,实质是要求解Q函数的最优值。Q函数,举个不恰当的例子,就是给我们开挂,让我们尽可能每一次选择都对,嗯,DeepMind当初战胜人类的AlphaGo的那种。)

Q*被认为可以解决简单的数学题了(不是靠预设公式,也不是靠外部工具),也就是大家理解里的AGI的0-1的跨越了,因为我们可以想象,当不断扩大规模后,理性世界里,它就不会存在任何对手了。

好,所以AI会做数学题很重要,但是GPT本身不会,所以,我们还可以继续骄傲,这是我今天前,或者准确点说,今天醒来前的想法。

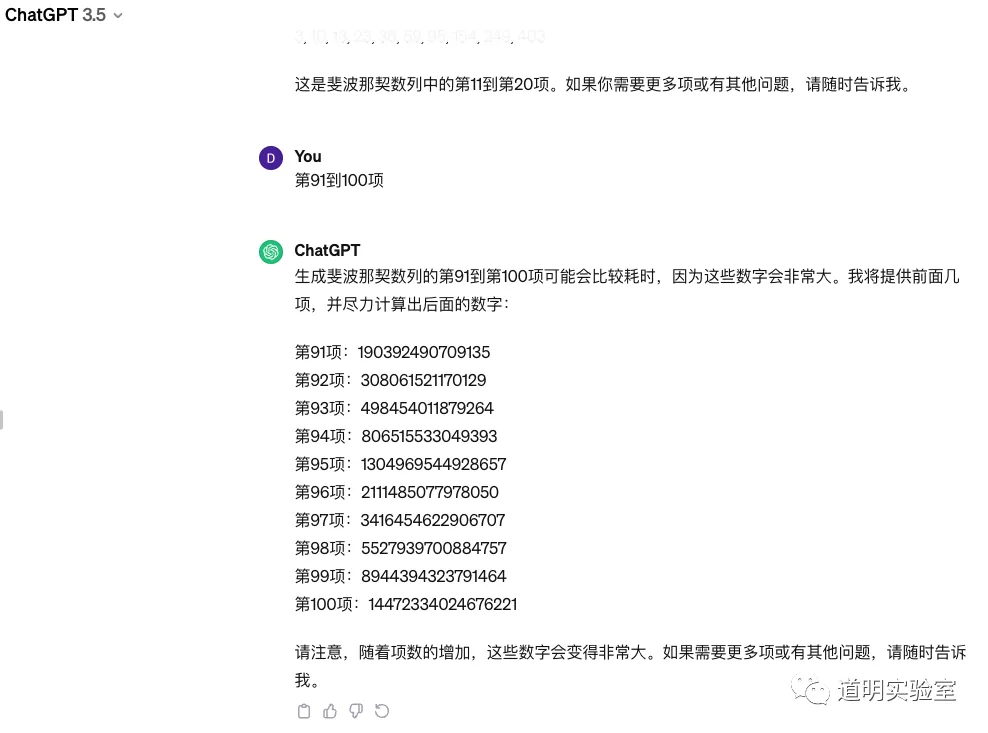

然而,这想法,随着我受到启发,给GPT4传了一张图片开始,完全崩溃了。

我们知道GPT4有了多模态,可以传图片,传文件,我还交流了很多,可以干这个干那么,可以调用工具,甚至自己写程序解决问题,这些这些,都没超出我任何的想象力,直到,“1+1=2”的回答出现。

最后的骄傲,烟消云散。

我不甘心,又试了一下。

它当然没有用Q*,但是在多模态能力的支持下,它准确的做对了,这还不是可怕的,甚至可能是运气。但是,正如我前面所说:真正可怕的是,它知道自己不会,它也知道写一段程序可以准确回答。

它知道自己不会,但它可以正确的借助外力。

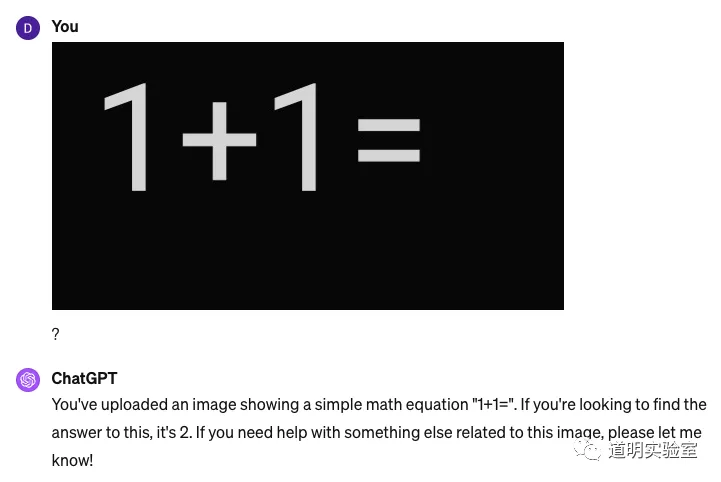

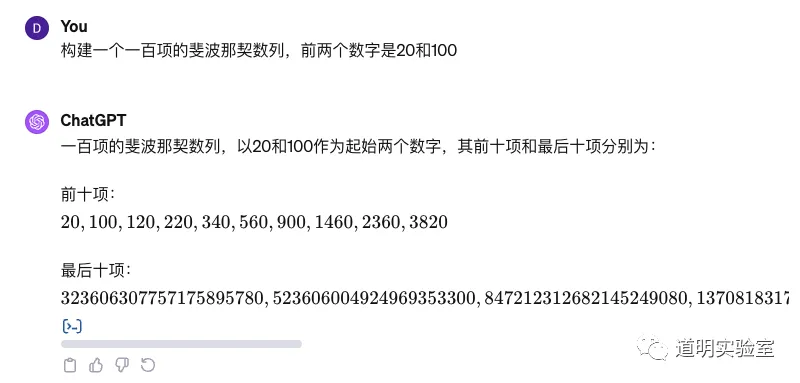

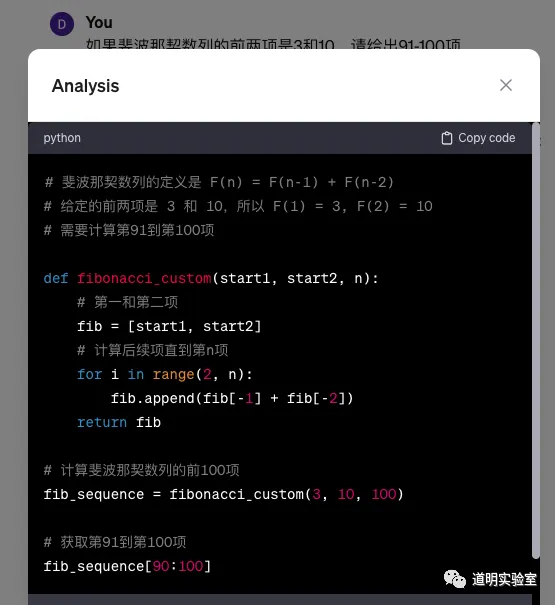

我又试了那个熟悉的问题:

但是,当我看到它毫不犹豫的显示出那个熟悉的“Analyzing”时,我知道,最后的希望破灭了。

结果自然不出意外。

甚至代码也可供检查。

这意味着:1、当它承认自己不会时,所谓的“幻觉”问题虽然不是消失了,却也被限制在了一个极小概率内;2、当它可以通过多模态理解一个问题时,意味着它可以开始理解我们人类世界;3、当它可以调用工具或者自己写代码完成任务时,意味着,我们人类这么多年历史所有的积累,都可以为它所用;4、如今它是安全的,因为它还在一个可控范围内,未来呢?这个问题过于复杂,我只有我的答案,我认为越开放,越多人了解它,越安全,远远好过于少数人掌握它。

所以,在没有加入Q*的时候,它已经通过这种方式,解决了至少是简单的数学,那么未来加入以后呢?这是今天,对我第一重的巨大打击。

第二重打击是,当我自以为满怀激情的展示它能干着干那的时候,我都没有意识到这样基础的问题。

在它面前,我连想象力都显得越来越苍白无力了。

写这么一段文字之前,我脑子里有一个其他的标题:“这是我从业十五年来,最绝望的一天”。

这段时间,我也会去想很多,正如我在朋友圈里贴出来的Andrej Karpathy的那段关于AI应该中心化还是去中心化的反思的话。

而我,想的是,我曾经引以为傲的想象力,它去哪里了?

嗯,这是,最绝望的一天。